NVIDIA RTX 2080/RTX 2080 Ti首发评测:感受12年来GPU最大革命

- 配件供应

- 2025-03-05 11:33:36

- 44

一、前言:NVIDIA革命性跨越显卡又热闹起来了作为GPU显卡行业的领头羊,NVIDIA的新产品发布节奏多年来一直非常稳,而且每一代都有极大的创新和提升(完全不知牙膏味儿),产品线布局十分丰富,生态系......

一、前言:NVIDIA革命性跨越显卡又热闹起来了

作为GPU显卡行业的领头羊,NVIDIA的新产品发布节奏多年来一直非常稳,而且每一代都有极大的创新和提升(完全不知牙膏味儿),产品线布局十分丰富,生态系统合作也是有着厚实的积累相当完备。

在显卡的江湖里,NVIDIA虽然说不上呼风唤雨,但始终也都是首屈一指的,GeForce更是几乎已经成了游戏卡的代名词。

2016年5月,我们迎来了Pascal帕斯卡架构的GeForceGTX10系列,不过当时恐怕谁都不会想到,帕斯卡家族的命会这么长,而新一代让我们苦苦等待了这么久。

最近几代产品,NVIDIA都会选择当年的3-6月份春天或春夏之交来发布,一般在3月份的GTC图形技术大会上首次披露,但今年非常特殊,一直拖到了9月份,比往年晚了几乎半年。

更令人称奇的是,NVIDIA这一次保密工作做的极好,直到发布前,我们都不知道新卡的架构是Volta伏特、Ampere安培还是Turing图灵,也不知道新卡的命名是GTX10系列还是GTX20系列,结果最终是RTX20系列。

出现这种局面,最主要的原因是这一代从架构技术到产品体系都发生了翻天覆地的变化,而研发全新一代架构、完善全新技术特性,都是需要花费无数精力、金钱和时间的(想想AMDZen憋了多久才出来再想想Intel酷睿老本吃了多少年)。

按照NVIDIA的说法,早在10年前就在设计和研发图灵架构了(当然当时应该没这个代号),主要是光线追踪方面,因为在此之前,光线追踪只能用于影视渲染,谁也不敢想象它能在游戏里实时呈现。

最终,NVIDIA创造奇迹,为PC游戏带来了实时光线追踪(即便是有条件的),也难怪黄仁勋骄傲地宣称图灵架构是2006年引入CUDA统一着色核心以来最大的革命。

而另一方面不得不面对的一个现实就是,显卡市场已经沉闷太久了,尤其是在电竞火热朝的形势下,显卡却迟迟没有跟上。

作为市面上仅有的两大GPU巨头之一,AMD近些年全力投入ZenCPU架构,虽然硕果累累,但也导致GPU方面进展缓慢,Polaris北极星架构的RX400/500系列只能在中低端市场混,Vega织女星架构的RXVega系列在高端市场又不具备足够的竞争力。

这种形势下,对手很容易懈怠,反正没什么压力,但幸运的是,NVIDIA并没有任性挤牙膏,反而奉上了一道更美味的大餐:全新架构、实时光线追踪、AI人工智能、GDDR6显存等都让人激动不已,而且第一次首发就奉上了三款新卡。

长久的等待终于值了,整个显卡市场也再次热闹纷呈起来。

接下来,我们就会探析一下这个革命性的Turing架构,以及全新的RTX2080Ti、RTX2080两款高端型号到底表现如何。

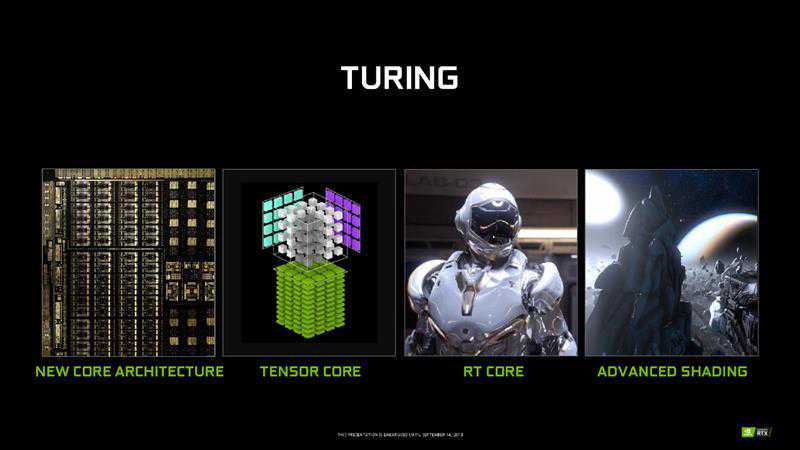

二、架构解析之全新内核体系

既然是一个全新设计的架构,我们就要好好看一看这个以计算机科学之父、人工智能之父艾伦·麦席森·图灵(AlanMathisonTuring)命名的Turing图灵新架构到底有哪些过人之处,不过硬件架构总是伴随各种高深晦涩的技术名词、技术原理,即便专业人士也得好好研究才行,所以这里我们仅从高级层面,介绍一下新架构的大致设计、技术概况,以及能带来的实际好处。

在以往,NVIDIA为专业级计算卡、消费级游戏卡设计的都是统一架构,只是具体内部模块布局、技术支持、核心大小不同。好处是可以统一开发,降低成本,坏处是缺乏针对性,技术资源要么浪费要么不够。

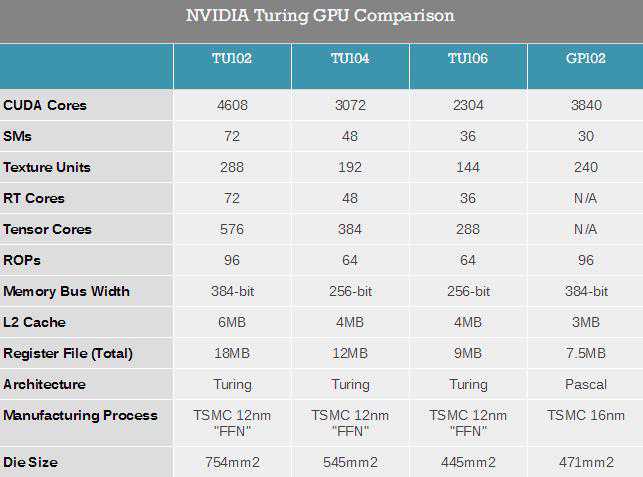

这一次,NVIDIA选择了分而治之。针对高性能计算、图形渲染、人工智能、深度学习等专业应用的是Volta伏特架构,目前只有一个超大核心GV100,是迄今为止GPU历史上最大的核心,台积电12nm工艺制造,集成多达210亿个晶体管,核心面积达815平方毫米,妥妥的怪物级核弹。

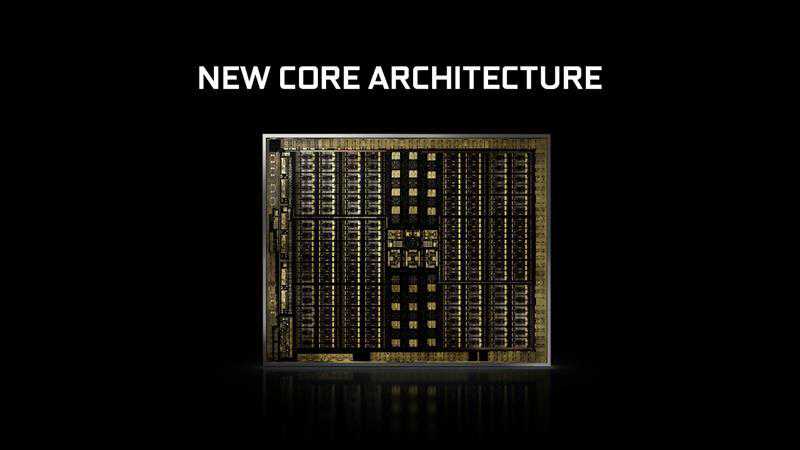

而针对游戏显卡的就是Turing图灵架构,也是台积电12nm(有说法称最初计划使用三星10nm),其中最大的核心TU102集成189亿个晶体管,核心面积754平方毫米,是仅次于GV100的史上第二大GPU核心。

相比上代Pascal帕斯卡家族的大核心GP102,它的晶体管数量增加了55%,面积则增大了60%,甚至是次级新核心TU104都超越了GP102,拥有136亿个晶体管、545平方毫米面积。

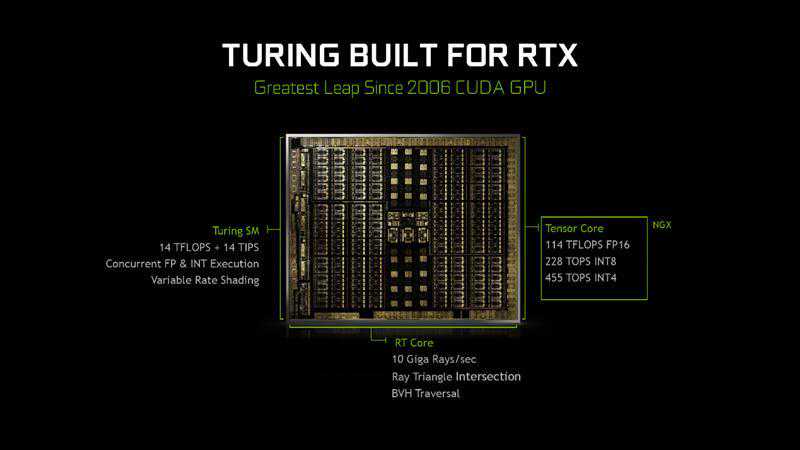

新架构核心之所以如此庞大,除了CUDA核心规模继续增大、升级Shading着色渲染之外,更关键的是RTCore光线追踪核心、TensorCore人工智能核心的加入,这也是新架构革命性变化的根本支撑。

拥有全新着色性能的SMCUDA核心阵列、支持高达每秒100亿条光线计算的RT光线追踪核心、为实时游戏画面导入AI人工智能加速的Tensor核心,三者就构成了图灵架构的三大支柱,各自有不同分工又互相协作,共同实现新的游戏渲染画面。

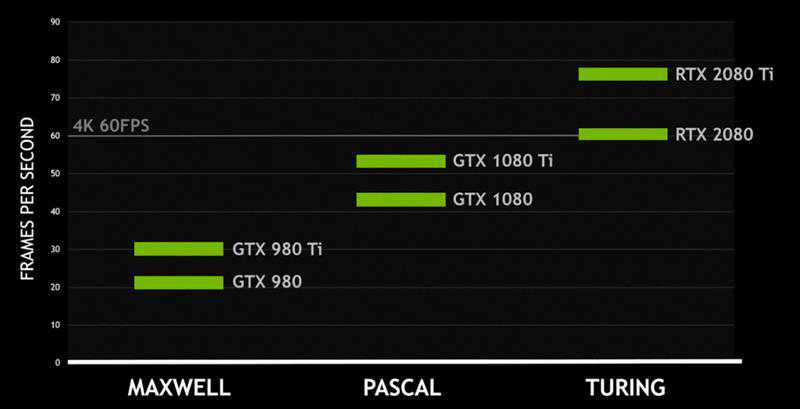

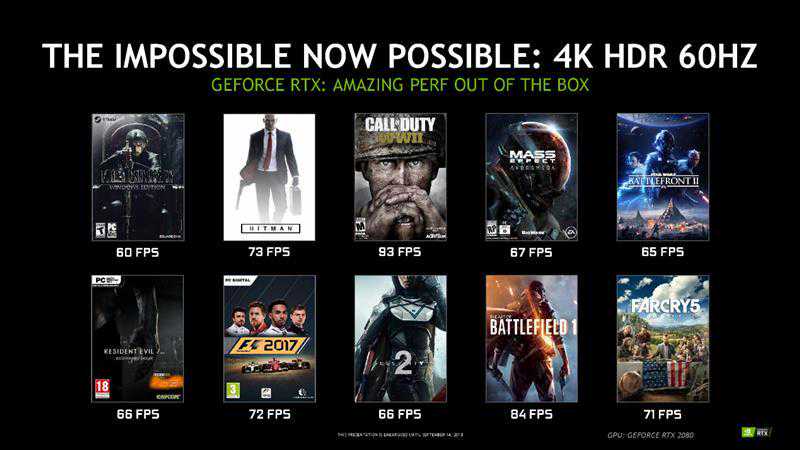

同时,NVIDIA强调新架构的单个CUDA核心着色渲染性能是帕斯卡架构的1.5倍,第一次可以在4K分辨率、HDR开启的情况下,提供流畅的游戏体验,真正开启4K时代。

按照NVIDIA的说法,RTX2080就能基本实现4K分辨率下60FPS的游戏帧率,RTX2080Ti更是能够达到70-80FPS。当然具体还要看游戏需求,以及游戏设置,特别是某些高要求的技术特性,光线追踪打开后别说4K了,就连1080p就比较吃力。

图灵架构的基本组成单元之一还是CUDA核心与SM流处理器阵列,这也是2006年的G80以来NVIDIAGPU的基石。

事实上,图灵架构的SM阵列也融合了伏特架构的不少特性,相比帕斯卡架构差别还是挺大的,比如每一组TPC里的SM阵列由一个增至两个,同时SM内部的组成方式也截然不同。

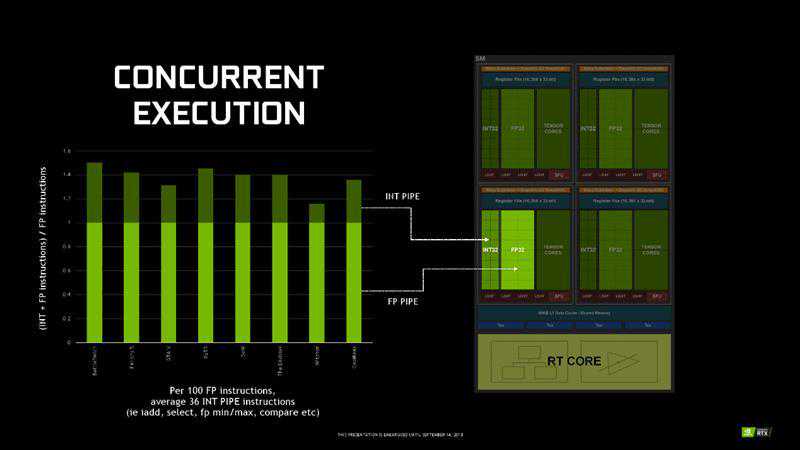

帕斯卡架构每个SM阵列集成128个FP32浮点单元,图灵架构则改成了2个FP64双精度浮点单元、64个FP32单精度浮点单元、64个INT32整数单元、8个Tensor核心、一个RT核心。支持浮点和整数并发操作,并有新的执行数据路径,类似伏特架构汇总的独立线程调度。

按照NVIDIA的统计,每执行100个浮点指令,平均会有36个整数指令,两种指令可以并发执行。

如此一来,帕斯卡架构的整数和浮点计算就可以分配得更加均衡,并与新的Tensor、RT核心相配合,更合理、高效地完成各种负载。

整体而言,图灵核心的CUDA阵列可以每秒执行14万亿次FP32浮点操作、14万亿次INT32整数操作。

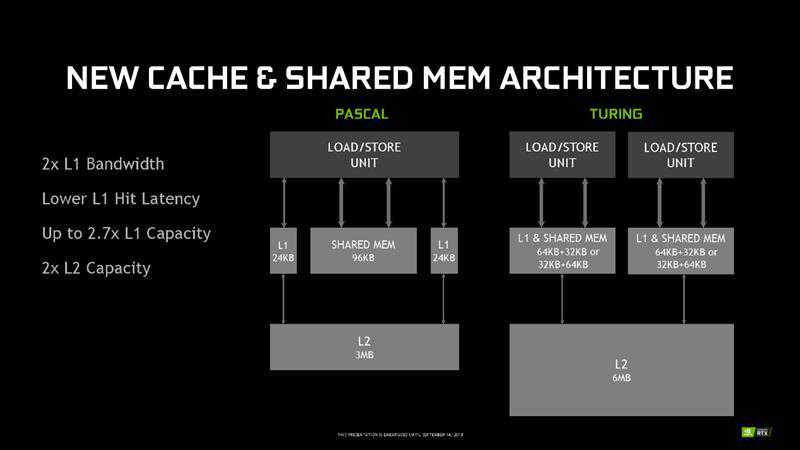

缓存架构也彻底变化,由两个载入/存储单元牵头,一级缓存和共享缓存整合在一起,而且容量灵活可变,可以是64KB+32KB,也可以是32KB+64KB,大大降低了延迟,带宽也翻了一番。

二级缓存容量则从3MB翻倍到6MB。

NVIDIA宣称,新架构每个CUDA核心的着色渲染性能比上代平均提升50%,部分游戏可达70%左右,VRMark虚拟现实测试成绩甚至翻了一番还多。

当然这只是基础理论上的数字,实际性能还要看其他部分和整体指标。

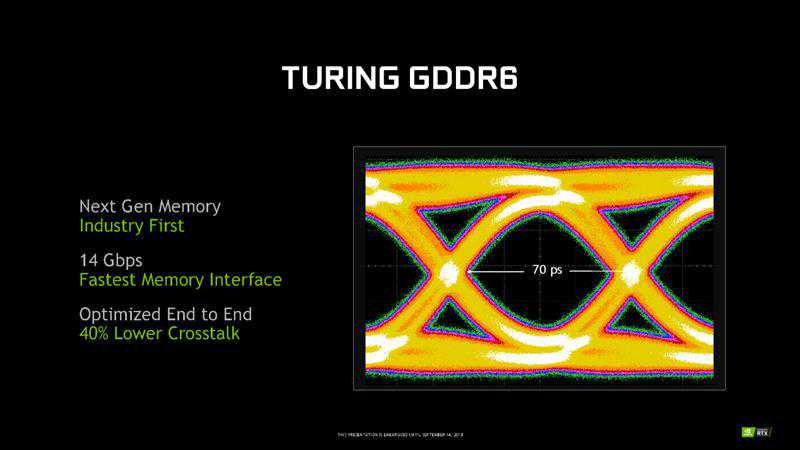

图灵架构还首发搭配新一代GDDR6显存,目前业界最快,等效频率高达14GHz,搭配352-bit位宽可以带来616GB/s的惊人带宽,相比于GTX1080Ti在位宽不变的情况下提升了27%,也比用了2048-bitHBM2高带宽显存的AMDRXVega64高了27%。

而且关键是,GDDR6的成本比HBM2低得多。

另外,NVIDIA还对新显存进行了各种优化,信号窜扰降低了40%,更利于运行稳定和进一步超频。

三、架构解析之RT核心、光线追踪

图灵架构和RTX20系列的最大亮点和卖点当然是——游戏实时光线追踪!

从第一颗GPUNVIDIAGeForce256诞生至今已经整整19年,GPU规模和技术越来越发达,但是最底层的图形渲染技术其实几乎一成不变,始终都是光栅化渲染,通过计算三角形和多边形来获得画面输出,好处是资源消耗容易控制,坏处就是距离真实画面相差甚远,甚至永远不可能接近。

光线追踪(RayTracing)技术则堪称图形界的“圣杯”,简单地说就是在图形渲染过程中实时跟踪物体和环境的光线,准确进行光线反射和折射、全局照明、物理阴影的绘制,可以带来近乎百分之百真实的渲染画面,尤其是光影效果。

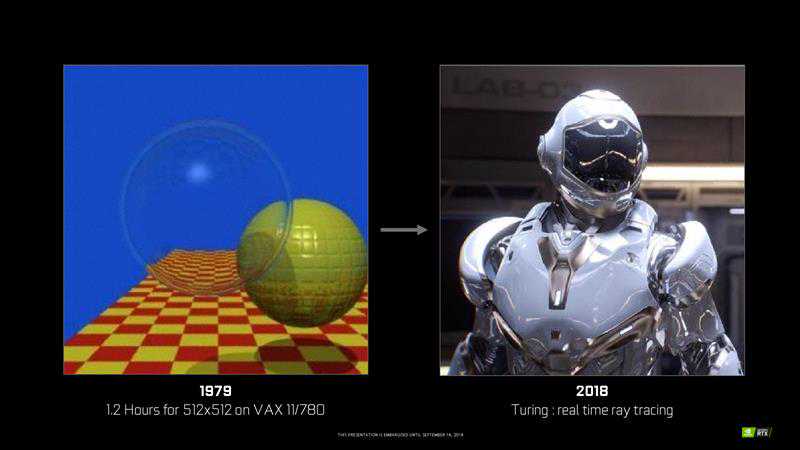

光线追踪技术其实并不新鲜,1969年的时候在IBM工作的ArthurAppel就提出了这种概念,当时叫做RayCasting,距今已经整整半个世纪。

1979年,TurnerWhitted研究出了递归光线追踪算法(RecursiveRayTracingAlgorithm)。

1984年,Carpenter等人发表了一篇关于分布式光线追踪的论文《DistributedRayTracing》,影响甚广。

但是,光线追踪的算法非常简单,稍有计算机图形只是的人都能理解,关键在于如何优化提高效率,因为它需要的计算量太过庞大,想想要实时计算场景中无数光线每时每刻的各种传播,那是多么恐怖,以前的GPU根本无力承担实时计算。

因此直到2006年迪士尼的《汽车总动员》(Cars),影视行业才开始使用光线追踪渲染,如今大多数的照片级渲染系统多时基于光线追踪的,但背后都是超大规模的计算机群在吃撑,一帧画面往往都要渲染几个小时。

虽然大家都在努力,但就在一个月前,如果说普通显卡可以在游戏里实现光线追踪(尽管是有条件的),相信绝大多数人都不会相信,但是NVIDIA的图灵做到了。

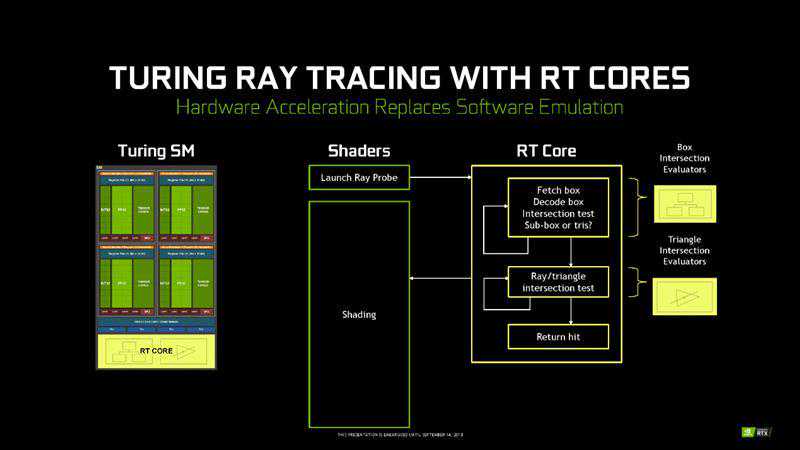

NVIDIA在图灵架构中集成了最多72个RTCore核心,每个SM单元一个,专门用来服务光线追踪运算,等于一个特殊的专用单元,由硬件加速取代软件模拟,效率自然要比CUDA这种通用单元高很多,就像GPU做并行计算比CPU强得多。

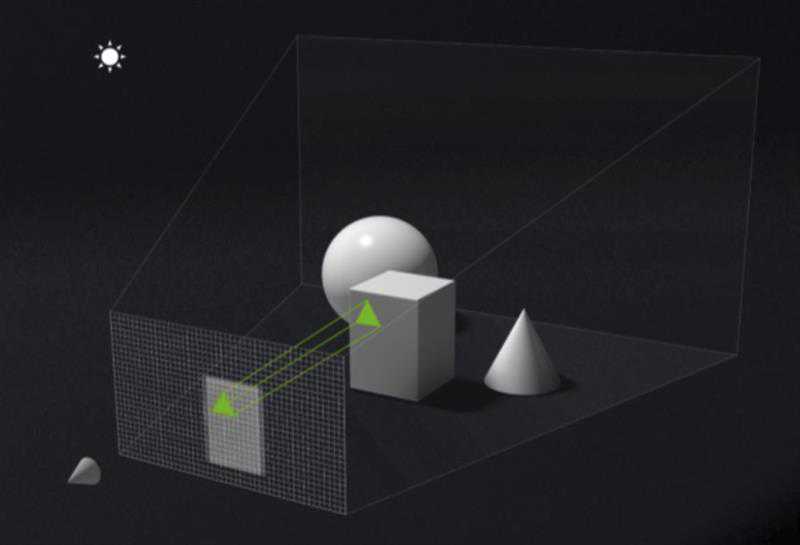

简单来说,图灵架构的光线追踪运算步骤是这样的:着色器单元首先发出光线探测请求,RTCore核心就开始完全接管下边的工作,并分为两个过程,其中包围盒求交评估单元(BoxIntersectionEvaluators)进行包围盒的获取和解码,并进行求交测试,得到子包围盒或者三角形。

如果是子包围盒,就返回重新执行,重复刚才的步骤。如果是三角形,那就交给三角形求交评估单元(TriangleIntersectionEvaluators),做下一步的求交测试,直到得到最终结果并输出给着色器,进行最终渲染。

看懵了对吧?懵了就对了……

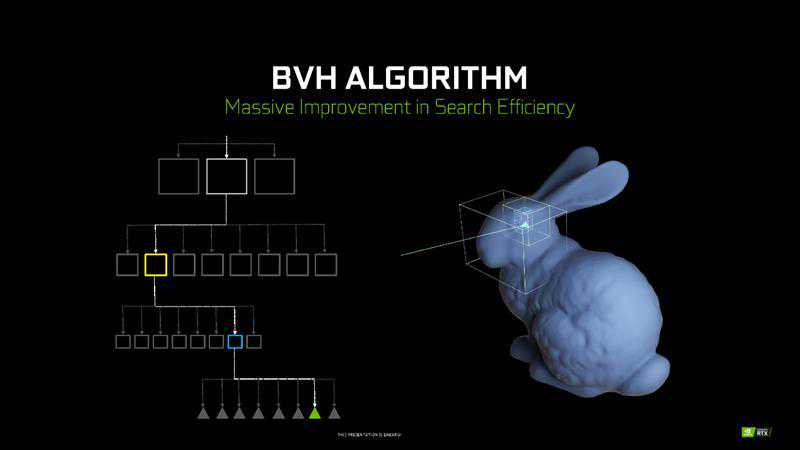

整个光线追踪计算过程中,运用的主要是BVH算法,也就是BoundingVolumeHierarchyTraversal,层次包围盒遍历的意思。

比如渲染对象是一只兔子,要几算一条光线和兔子本身的交互,就把兔子所在空间划分成N个包围盒,计算光线和哪一个包围盒相交,是的话就再把这个包围盒继续划分成N个更小的包围盒,再次计算相交,如此反复,一直找到和光线相交的三角形所在的包围盒,再对这个三角形进行最终的渲染。

BVH算法可以大大减少计算每一条光线最近相交点所需要遍历的三角形数量,而且只需要进行一次就能给所有光线使用,大大提高了执行效率。

除了硬件方面的工作,软件方面既有NVIDIA自己的OptiX光线追踪引擎、GameWorksSDK光线追踪模块,也有微软的DirectX12Ray-Tracing(DXR)API、WindowsML中间件,后者会在即将发布的Windows102018年秋季更新版中正式提供。

性能方面,RTX2080Ti在精简了四个只有68个RT核心的情况下,每秒钟可以计算超过100亿条光线,大约等于100TFlops(每秒1000亿次浮点运算)。

而上代GTX1080Ti虽然也能执行光线追踪,但因为没有专用单元和算法,效率只有RTX2080Ti的大约十分之一,不足以实时用于游戏。

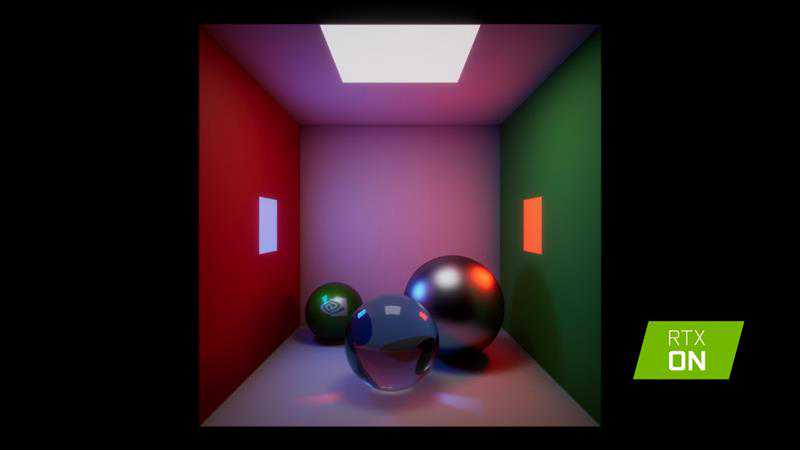

接下来欣赏欣赏NVIDIARTX光线追踪的效果和对比:

↑↑↑官方DEMO

↑↑↑官方DEMO

目前支持NVIDIA光线追踪技术的游戏有11款(和首发时相比没变),分别是:

-《神力科莎》(AssettoCorsaCompetizione)

-《原子之心》(AtomicHeart)

-《战地5》(BattlefieldV)

-《控制》(Control)

-《应征入伍》(Enlisted)

-《逆水寒》(Justice

-《剑网3》(JX3)

-《机甲战士5:雇佣兵》(MechWarrior5:Mercenaries)

-《地铁:离去》

-《ProjectDH》

-《古墓丽影:暗影》(ShadowoftheTombRaider)

不过,RTX20系列上市初期,可以玩的光线追踪游戏暂时还是零,比如《古墓丽影:暗影》首发不支持得后期打补丁,《战地5》则跳票了。

四、架构解析之Tensor核心、AI加速

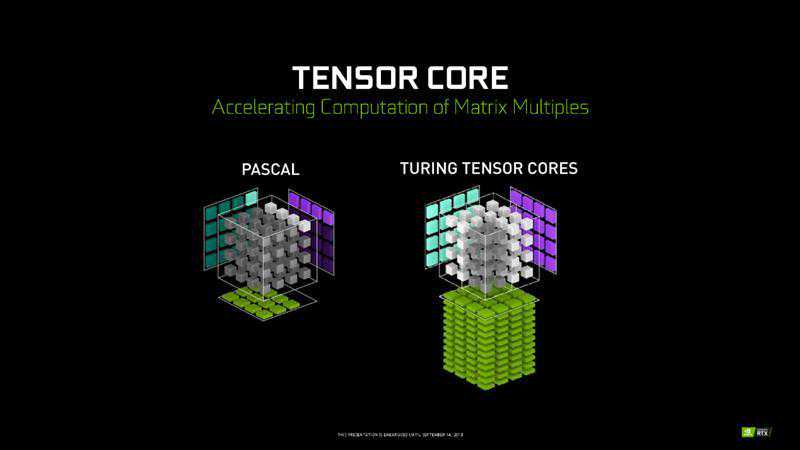

NVIDIA在伏特架构上引入了全新的专用处理模块TensorCore,也就是张量计算核心,重点用来支持深度学习、高性能计算(也是晶体管大户)。

图灵架构则是在游戏卡上引入TensorCore,同时针对游戏图形应用做了大量的调整优化,尤其是浮点精度方面。

Tensor的意思是张量,不同于我们常见的标量(零维)、矢量(一维)、矩阵(三维),拥有三维或者更高维度,简单地说就是一个数据容器,可以包含多个维度的数据。

现在火热的深度学习,就运用了超大规模的数据运算,其中就经常会用到矩阵融合乘加(FMA)运算,Tensor核心就是为这种矩阵数学运算专门服务的。

它可以对两个4×4FP16浮点矩阵进行相乘操作,然后将结果加入到另一个4×4FP16/FP32浮点矩阵中,最终输出新的4×4FP16/FP32矩阵,这叫做混合精度数学运算,因为输入矩阵是半精度,结果则可以达到全精度。

每个时钟周期内,图灵架构的Tensor核心可以执行64个FMA运算,从而大大加速矩阵运算,可用于新的神经实时图形渲染、深度学习训练和推理。

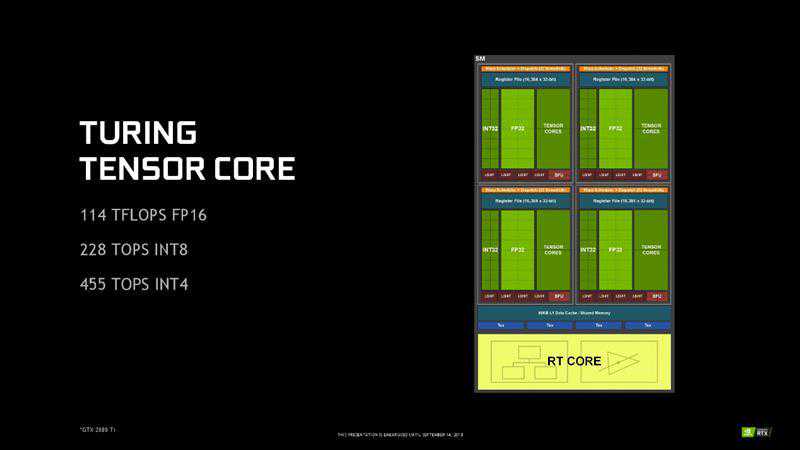

图灵架构每个SM阵列里有8个Tenor核心,总计576个,完整支持114TFlopsFP16浮点运算(每秒114万亿次),同时支持228TOPSINT8、455TOPSINT4整数运算(每秒228亿次、455亿次),后者是伏特架构里没有的。

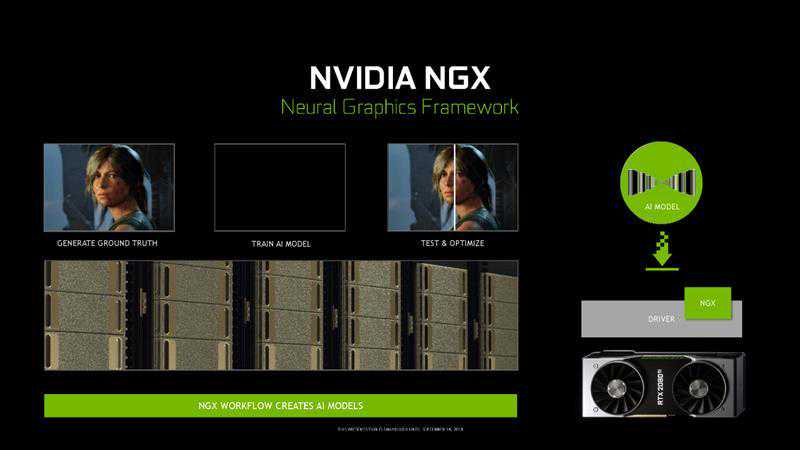

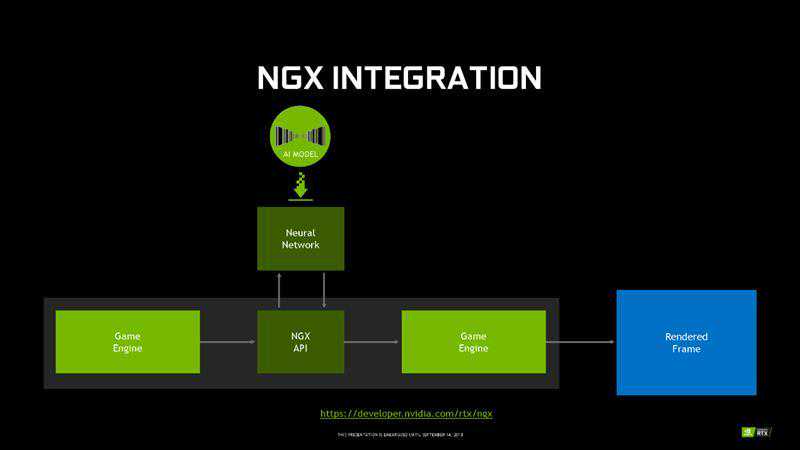

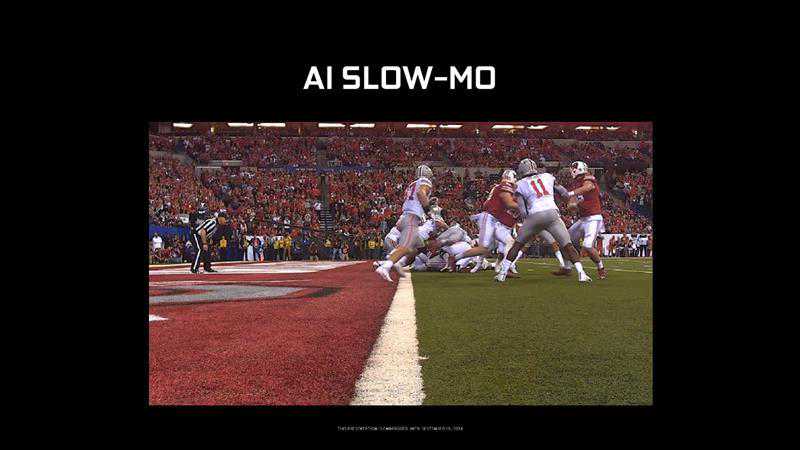

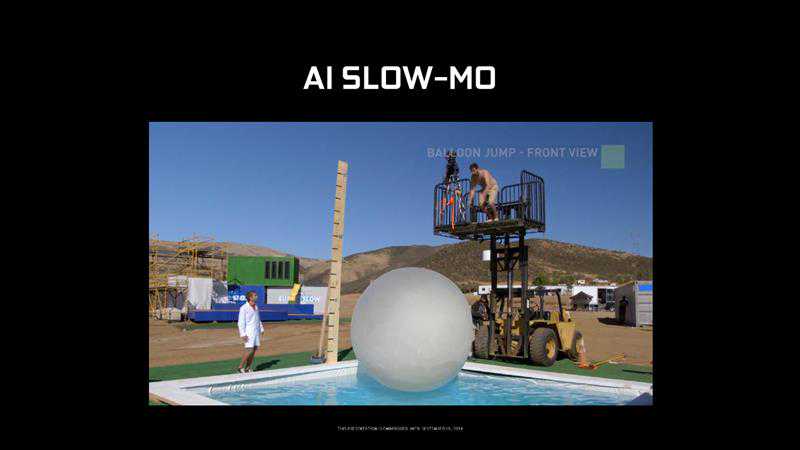

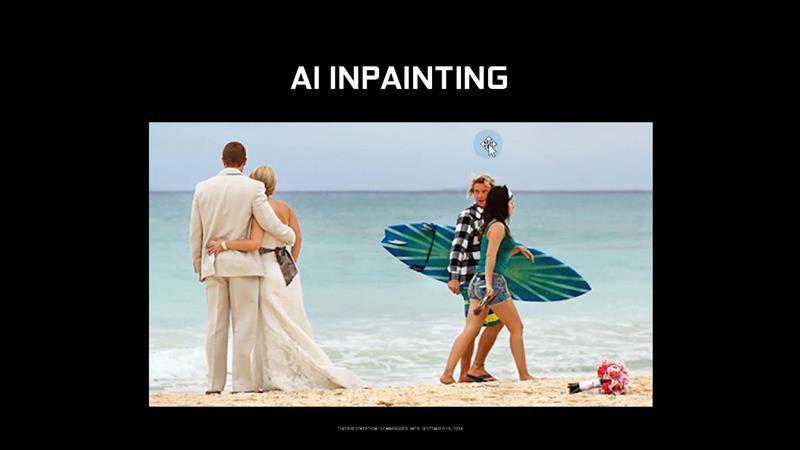

NVIDIA把看起来高深莫测的Tensor核心放到游戏卡里,显然不是做专业运算的,其深度学习能力也是为游戏服务的,结合新的神经图形框架(NeuralGraphicsFramework),简称NGX,可以在游戏中实现DLSS深度学习超采样抗锯齿、AISuperRez超级分辨率、AISlow-Mo慢动作、AIInPainting等等。

这些计算繁琐、资源消耗巨大的操作,在以往也可以实现,但会付出很大的代价,效果也不尽如人意,如今有了新的Tensor核心,就可以建立属于GPU核心自己的DNN深度神经网络,将AI融入游戏。

NVIDIA已经向游戏引擎开放NGXAPI,将其融入其中,实现底层加速。

另外和很多AI应用类似,NVIDIAGeForceExperience软件的作用也非常重要,它会自动匹配显卡型号,从云端训练的AI模型哪里下载相应的NGX软件包,并定期更新,达到越用越好、甚至是因人而异的效果。

AIInPainting:可以抹掉画面中不需要的内容,也可以智能补全缺失的内容,完全超越PS抠图的存在。它同样来自现实中大量真实世界图片的训练推理。

其实,慢动作和修图这两项在之前就曾有相关报道,显然NVIDIA在硬件、算法两个方面都实现了真正的突破。

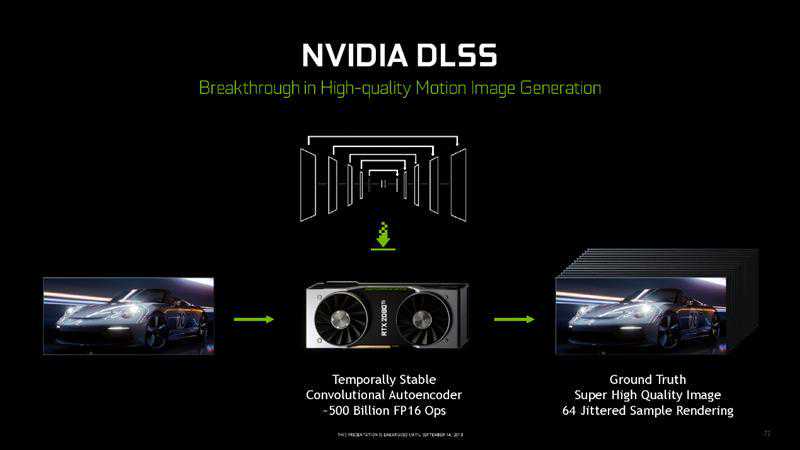

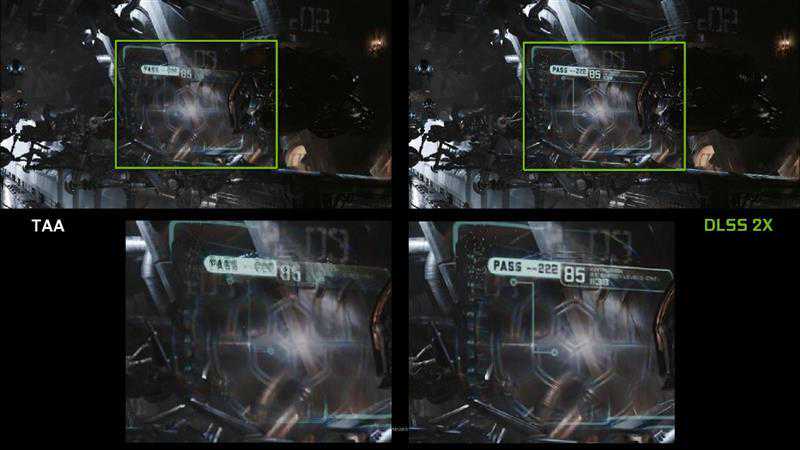

接下来就是重中之重的DLSS(深度学习超采样抗锯齿)。

我们知道,传统的光栅化图形渲染画面会存在各总各样的锯齿(狗牙),所以GPU厂商都会在后期处理中加入各种各样的AA抗锯齿技术,但传统抗锯齿都是由GPU去运算的,效果参差不齐不说,最关键的是会消耗大量的GPU资源,开启之后让游戏卡得没法玩再正常不过了。

DLSS深度采样超采样抗锯齿则和传统抗锯齿技术走了一条完全不同的路,它是在NVIDIA超级计算机上进行训练,而不再消耗GPU本身的资源。

针对每一款游戏,NVIDIA会在运算建立对应的训练神经网络,收集大量的64x超采样数据,对像素点进行64次偏移着色合成输出,理论上可以获得近乎完美的抗锯齿平滑效果,同时还会对比和普通渲染画面之间的差异,调整网络权重,反复迭代,最后获得更合理的抗锯齿画面效果,还可以避免传统TAA时间抗锯齿的运动模糊等问题。

云端训练完成后,NVIDIA会通过GFE软件将成果分发给玩家,再用到游戏中,而且随着游戏运行得越多,DLSS学习效果就会越来越优化,甚至每个玩家都可以得到属于自己的不同效果。

当然了,这也意味着NVIDIA需要和每一款游戏或者每一个游戏引擎合作,去进行专门的优化,还是相当费时费力的,不过考虑到NVIDIA在游戏行业广泛深入的合作关系,这方面倒不必担心。

尤其是随着合作优化的深入,NVIDIA完全可以建立起属于自己的技术壁垒,让对手望尘莫及,进一步带动大量玩家忠实地跟随NVIDIA。

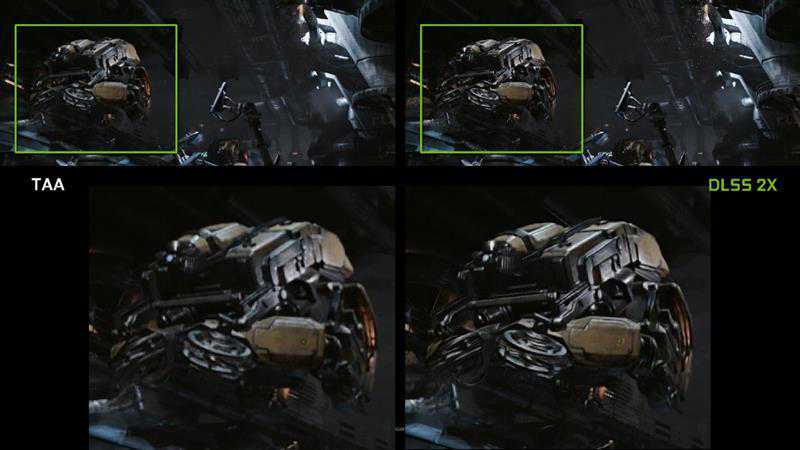

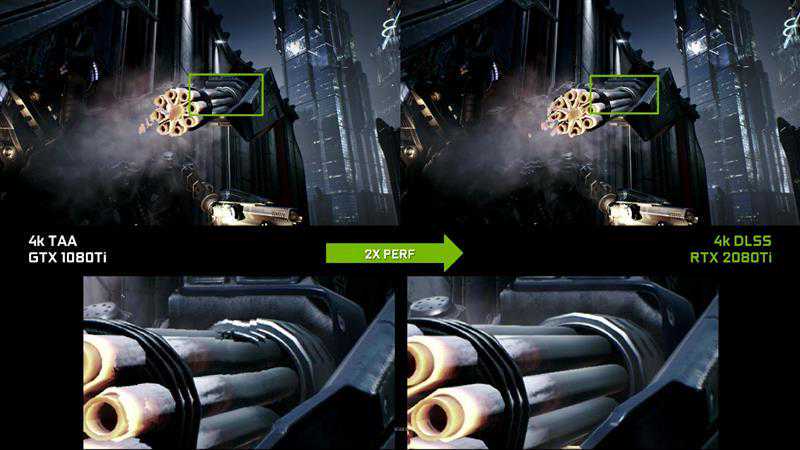

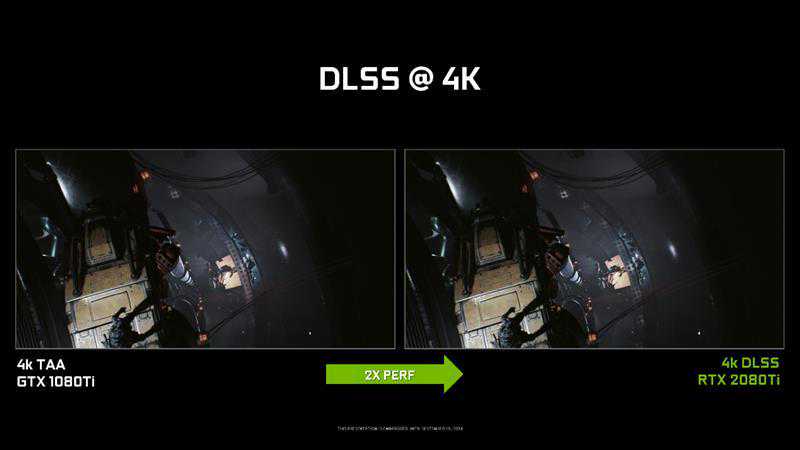

以上是2xDLSS与传统64xSSAA、TAA的效果对比,大家可以仔细观察一下画面细节。

更神奇的是,DLSS因为基本不需要消耗GPU本地资源,因此可以大大释放GPU性能,让其专心渲染游戏,提升性能。

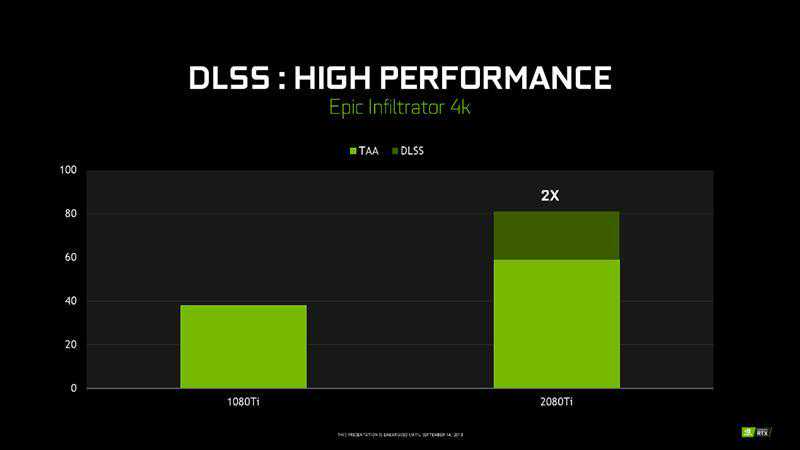

比如根据官方数据,Epic的《渗透者》(Infiltrator)游戏里,4K分辨率下1080Ti开启TAA平均帧率还不到40FPS,2080Ti开启DLSS则能达到80FPS,提升了整整一倍!

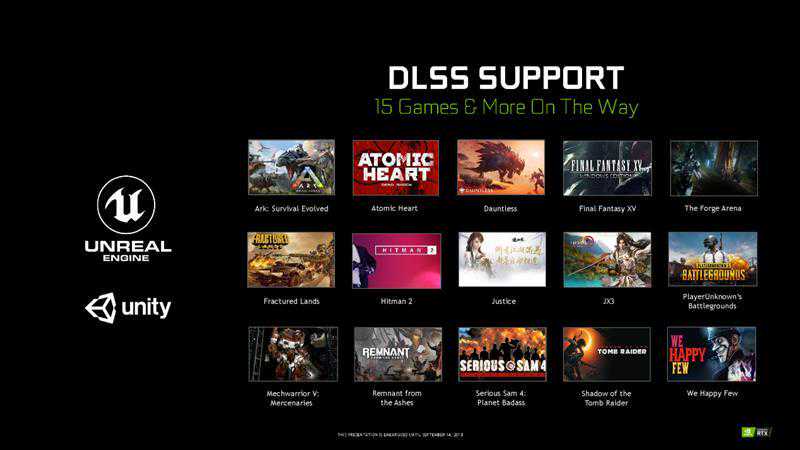

游戏支持方面也不是啥大事儿,RTX20系列发布之初就有16款游戏(PPT上写错了),现在产品还没完全上市就已经增加到25款。

首发名单如下:

-《方舟:生存进化》(Ark:SurvivalEvolved)

-《原子之心》(AtomicHeart)

-《无畏》(Dauntless)

-《最终幻想XV》(FinalFantasyXV)

-《破碎之地》(FracturedLands)

-《杀手2》(Hitman2)

-《奈恩群岛》(IslandsofNyne)

-《逆水寒》(Justice)

-《剑网3》(JX3)

-《机甲战士5:雇佣兵》(Mechwarrior5:Mercenaries)

-《绝地求生》(PlayerUnknown’sBattlegrounds)

-《遗迹:灰烬重生》(Remnant:FromtheAshes)

-《英雄萨姆4:星球恶棍》(SeriousSam4:PlanetBadass)

-《古墓丽影:暗影》(ShadowoftheTombRaider)

-《锻造竞技场》(TheForgeArena)

-《少数幸运儿》(WeHappyFew)

新增名单如下:

-《暗黑血统3》(Darksiders3)

-《飞向月球:财富》(DeliverUsTheMoon:Fortuna)

-《恐惧群狼》(FeartheWolves)

-《地狱之刃:塞娜的献祭》(Hellblade:Senua'sSacrifice)

-《KINETIK》

-《前哨零》(OutpostZero)

-《超杀:行尸走肉》(Overkill'sTheWalkingDead)

-《人渣》(SCUM)

-《风暴奇兵》(Stormdivers)

这其中有5款游戏同时支持RTX光线追踪和DLSS抗锯齿技术,分别是《原子之心》、《逆水寒》、《剑网3》、《机甲战士5:雇佣兵》、《古墓丽影:暗影》。

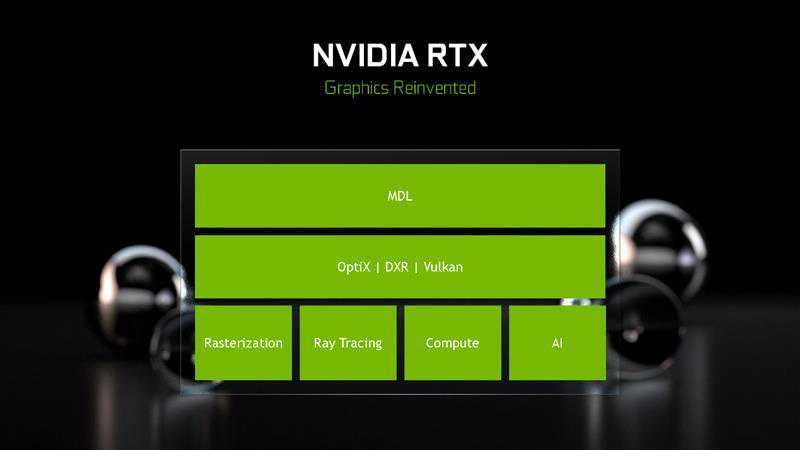

五、架构解析之混合渲染、高级渲染

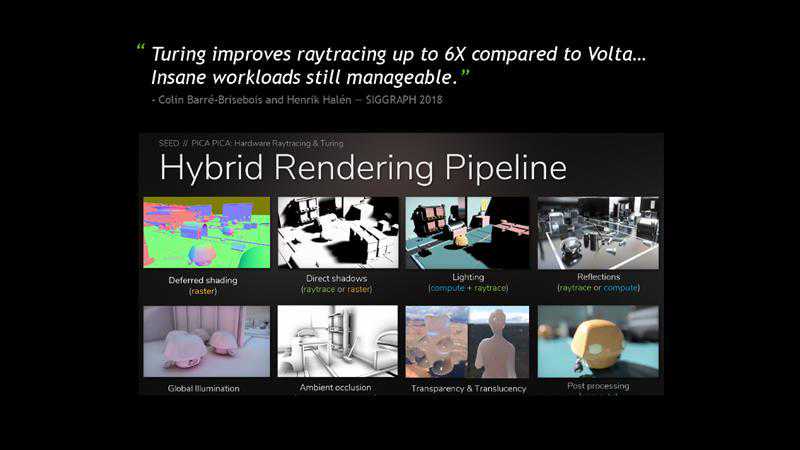

图灵架构虽然引入了光线追踪,但以现在的GPU性能和技术算法,显然不可能把一切渲染都交给光线追踪,传统的光栅化渲染依然离不开。

因此,NVIDIA在图灵架构中使用了混合渲染流水线(HybridReringPipeline),针对不同的工作负载,分别使用CUDA核心的光栅化渲染、RT核心的光线追踪渲染、Tensor核心的计算渲染的一种或多种组合,获得渲染效率的最大化。

当然,在典型的混合渲染场景中,也不会同时用到三种渲染方式。

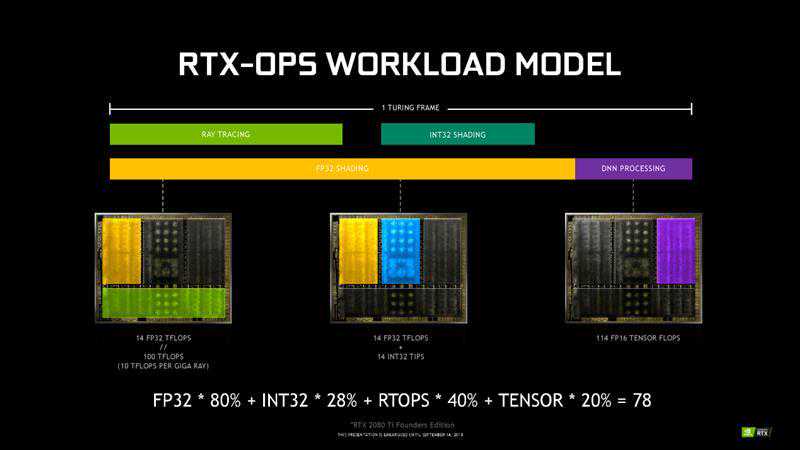

如此一来,如何衡量图灵架构的实际渲染性能,就不能用以前的算法了,而要根据三种不同渲染方式的使用程度,综合衡量。

以上就是在一个典型的渲染场景中,图灵架构各种渲染方式的组合分配,一般而言80%的时间里使用着色器FP32浮点运算、28%的时间使用着色器INT32整数运算、40%的时间使用RT核心、20%的时间使用Tensor核心FP16浮点运算。

比如RTX2080Ti,结合各个部分的峰值性能,最终的渲染性能就是:

14×80%+14×28%+100×40%+114×20=78T

NVIDIA给这个结果自定义了一个单位RTX-OPS,可以理解为RTX显卡每秒钟能执行的操作数,也就是780亿次。

与此同时,图灵架构也引入了多种新的、更高级的Shade着色渲染技术。

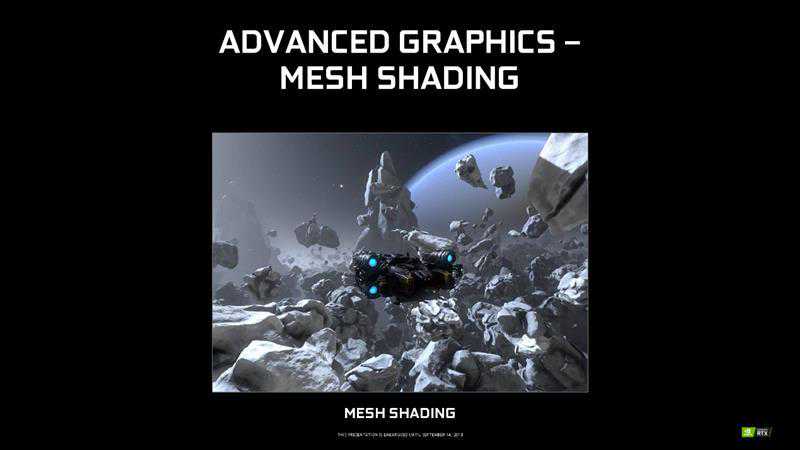

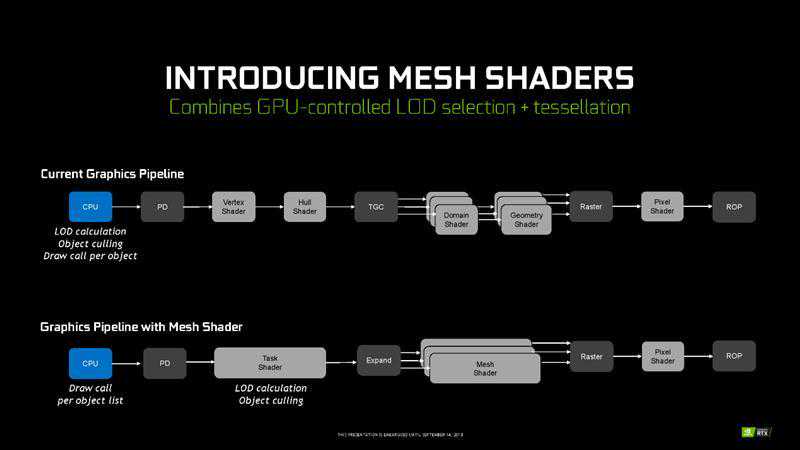

比如网格渲染(MeshShading):面对复杂、庞大的场景,不再逐一计算每一个物体的所有细节,而是由GPU灵活地计算物体细节等级(LOD),踢出被遮挡的,削弱低细节的,再加上传统曲面细分技术,更高效地生成真正实际需要的三角形,也能大大减轻CPU负担。

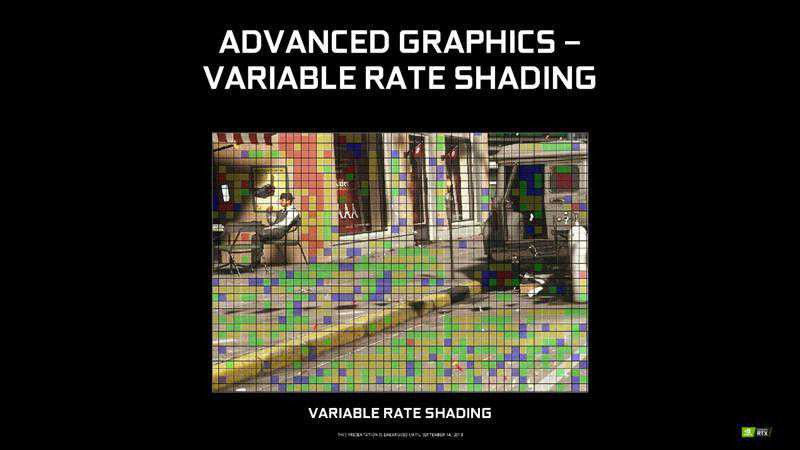

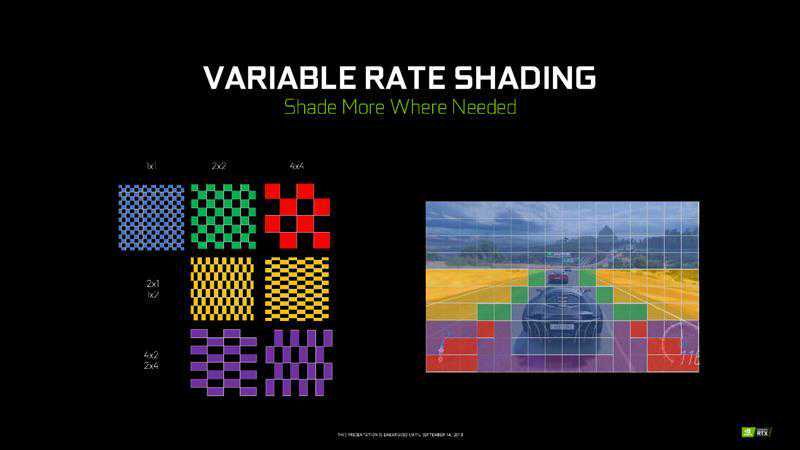

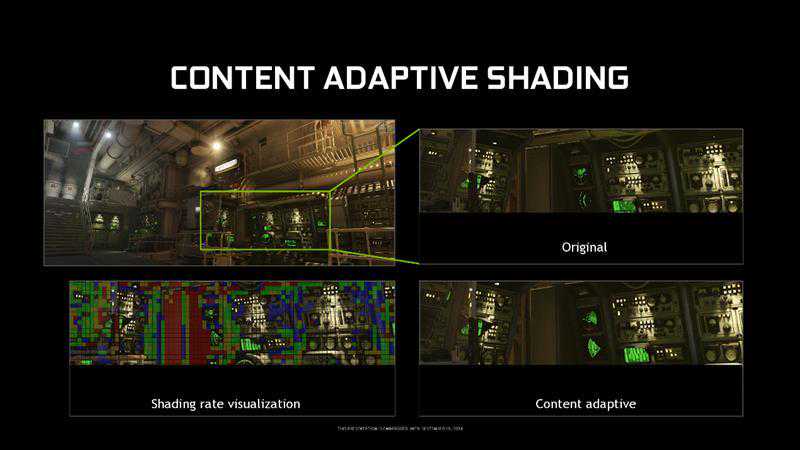

可变率着色(VariableRateShading):按照场景中的复杂度不同,分区域动态调整着色速率和资源分配,目的还是减轻GPU负担、避免不必要的资源浪费,最终有利于提升渲染效率、游戏帧率。

可变速率着色渲染有很多应用场景,比如内容适应性着色(CAS)、动作适应性着色(MAS)、注视点选择性渲染、镜头优化。就不一一展开了。

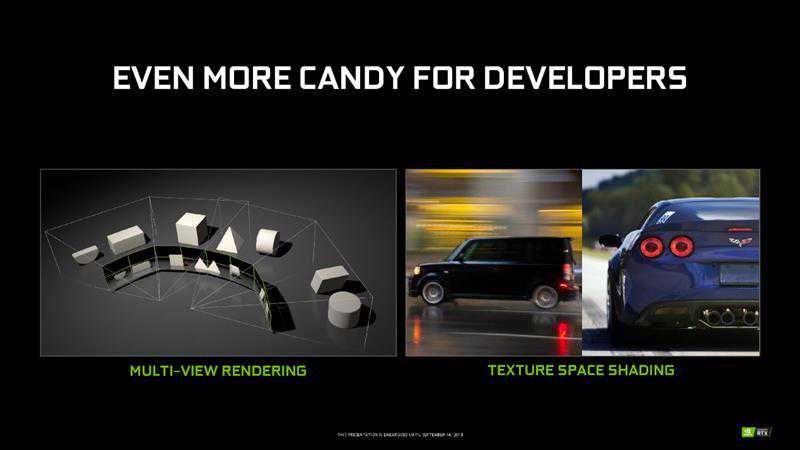

多角度渲染(Multi-ViewRering)、纹理空间共享(Texture-SpaceSharing)。

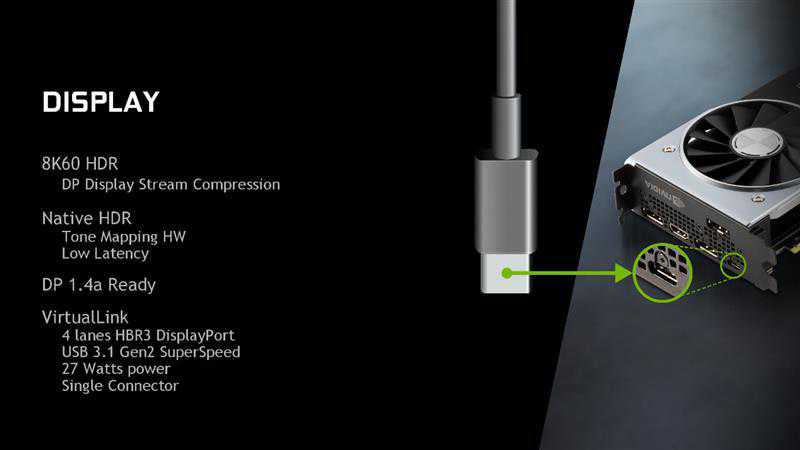

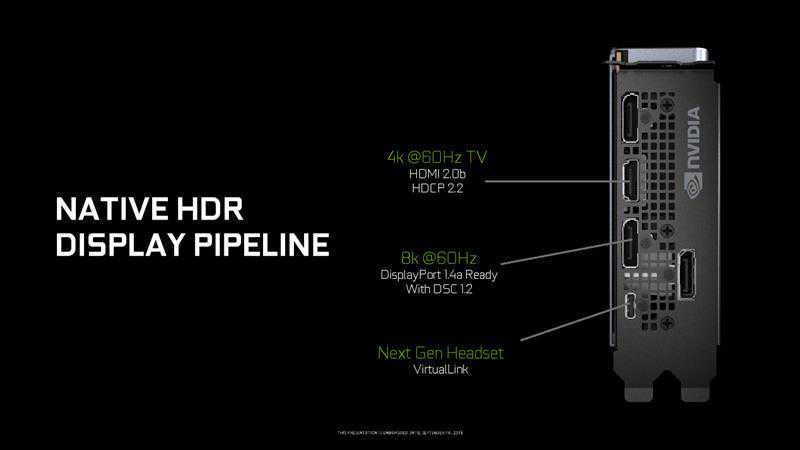

显示输出方面,图灵新卡既有标准的、接口(同时为标准做好了准备),分别最高支持4K/60fps、8K/60fps输出,并首次加入了USBType-C接口,用于支持VirtualLinkVR应用,提供三个HBR3DisplayPort通道,支持速度,可提供最大27W供电能力。

VirtualLink标准由NVIDIA、Oculus、Valve、AMD/微软牵头制定,是一种开放的行业标准,可以让VR头显摆脱多条线缆的束缚,只需一根高速USBType-C数据线,就可以直连显卡和VR头显。

而现在的VR头显,比如说HTCVive,就需要HDMI、USB、电源三条线。

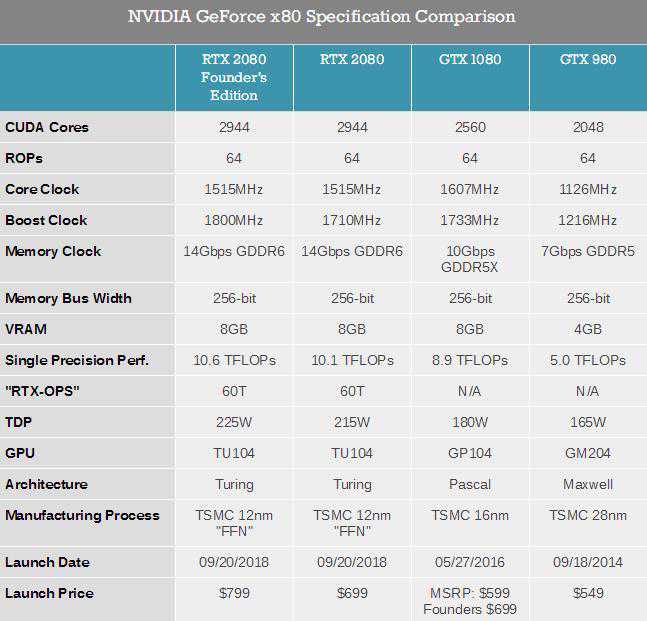

七、架构解析之三大核心与型号

图灵家族除了架构本身变化巨大,产品体系也和以往明显不同,首发一口气就是三款型号RTX2080Ti、RTX2080、RTX2070,而且分别对应三个不同核心TU102、TU104、TUF106,而以往的x80、x70都是共享一个核心。

具体原因不详,可能是新一代核心太大,x70直接用大核心阉割成本比较高,还不如再造一个省钱的小核心。

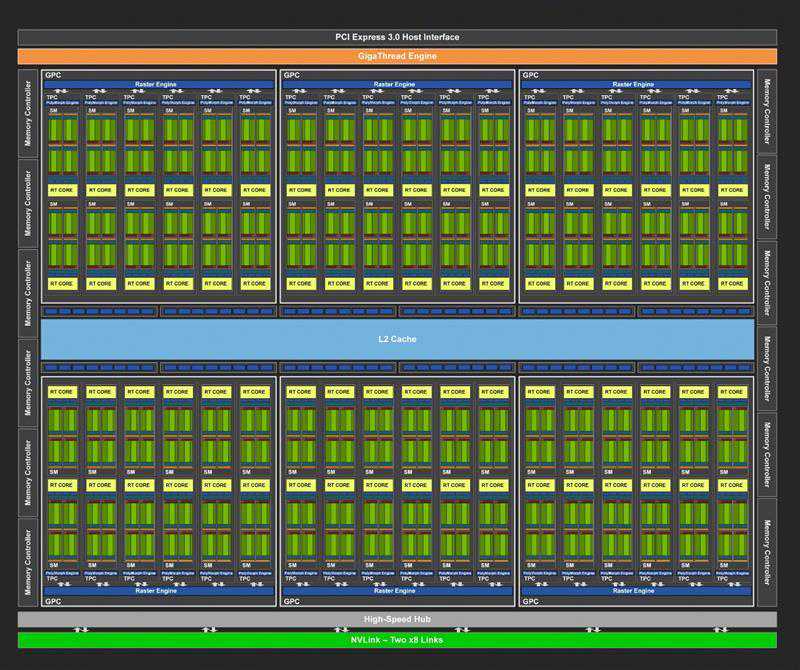

这就是最顶级的TU102核心,186亿个晶体管、754平方毫米面积确实不是盖的。

内有4608个CUDA核心,分为6组GPC、36组TPC、72组SM阵列(每组SM64个CUDA核心),同时有72个RT核心、576个Tensor核心、288个纹理单元、96个ROP光栅单元,二级缓存容量6MB,寄存器文件18MB,352-bit位宽。

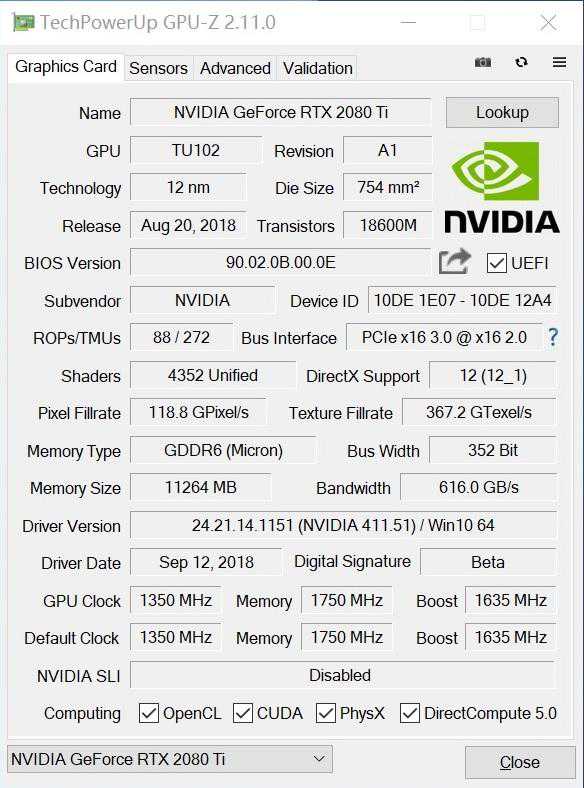

不过,RTX2080Ti并未完全使用整个TU102核心,而是有所精简,仅提供4352个CUDA核心(68组SM阵列),RT核心则减少为68个,Tensor核心544个。

目前只有QuadroRTX8000用了完整的TUF102,可能是初期良品率不足,优先供给专业市场,也可能是功耗和发热在游戏卡上不好控制,还有可能是留一手……

RTX2080Ti的核心频率基础为1350MHz,加速频率FE公版做到了1635MHz,非公版则规定是1545MHz,当然大家可以随意超频。

显存搭配11GBGDDR6,等效频率14GHz,带宽为616GB/s,整卡功耗260W。

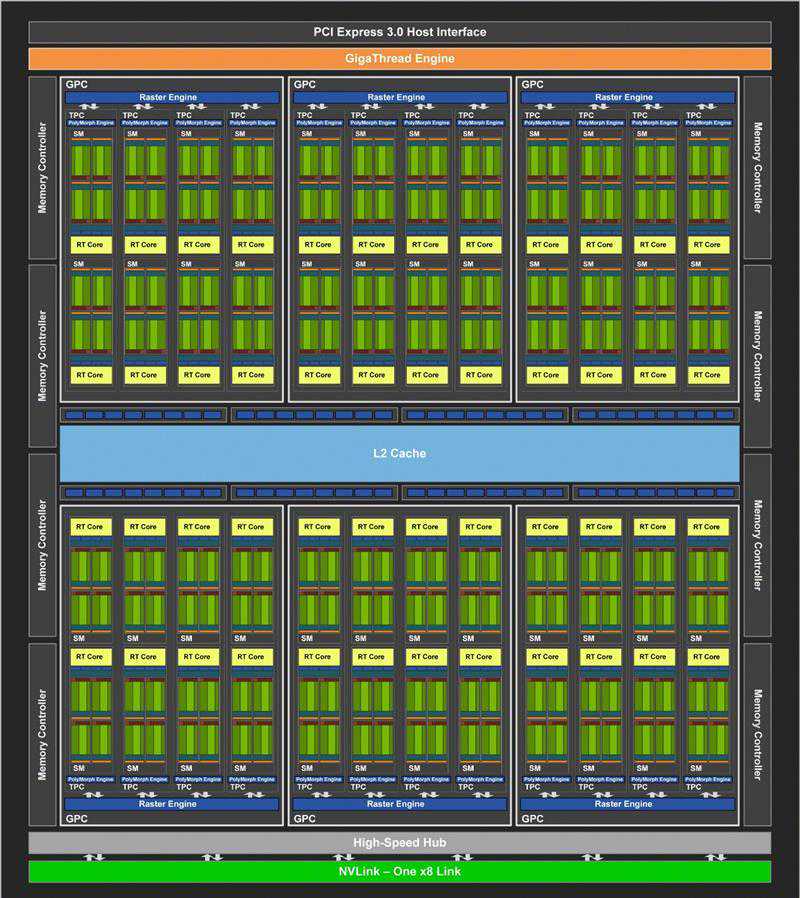

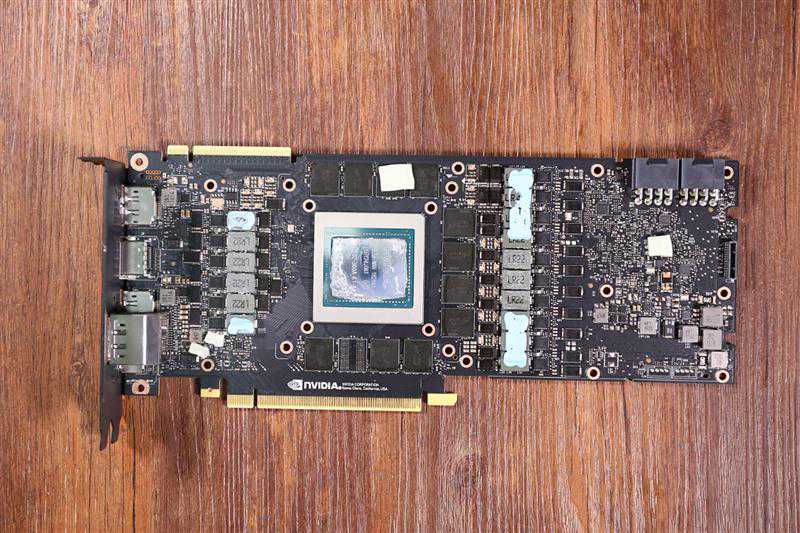

TU104核心,136亿个晶体管,545平方毫米,比帕斯卡家族的大核心GP102都要大一圈。

它集成了3072个CUDA核心,划分为6组GPC、24组TPC、48组SM(每组SM还是64个),同时有192个纹理单元、64个ROP单元、384个Tensor核心、48个RT核心,二级缓存容量4MB,寄存器文件12MB,显存位宽256-bit。

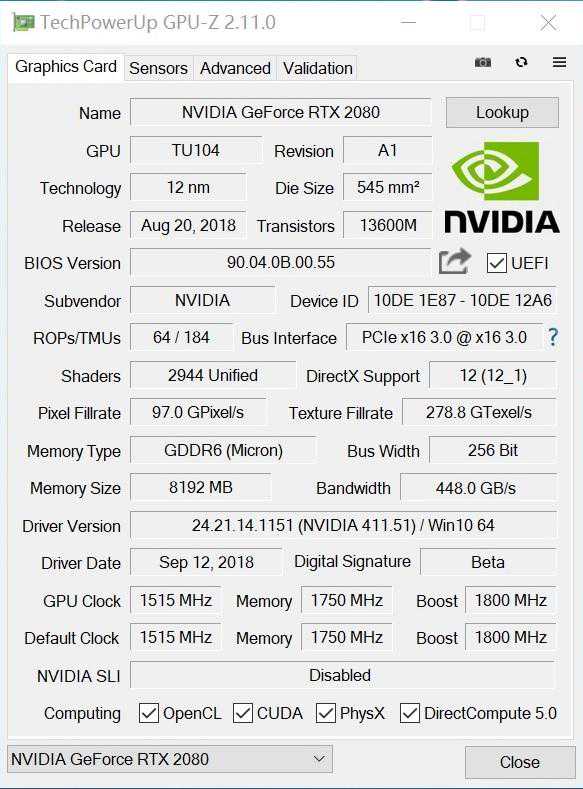

RTX2080同样没有用满TU104核心,而是精简了两组SM,提供2944个CUDA核心、368个Tensor核心、46个RT核心,完整版还是在专业卡上,QuadroRTX6000。

RTX2080核心基础频率1515MHz,加速频率非公版1710MHz,公版直接定在1800MHz,搭配8GBGDDR6显存,等效频率14GHz,带宽448GB/s,功耗225W。

它的渲染性能为60TRX-OPS,相比于RTX2080Ti削弱了23%,光线追踪性能8GigaRays/s(每秒80亿条光线),削弱了20%。

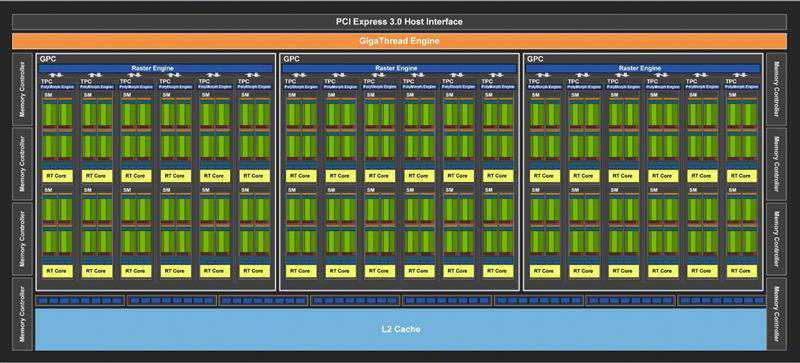

TU106核心,108亿个晶体管,445平方毫米,相比GP102也只是分别差了10%、6%,更可见图灵家族的庞大。

TU106核心內建2304个CUDA核心,分为3组GPC、18组TPC、36组SM阵列(每组继续64个),同时有144个纹理单元、64个ROP单元、288个Tensor核心、36个RT核心,二级缓存容量4MB,寄存器文件9MB,显存位宽还是256-bit。

RTX2070终于用了完整的TU106核心,核心频率基础1410MHz,加速公版1710MHz、非公版1620MHz,继续搭配8GB14GHzGDDR6显存,功耗185W。

渲染性能45RTX-OPS,相比于RTX2080Ti、RTX2080分别低了25%、42%,光线追踪性能6GigaRays/s(每秒60亿条光线),分别低了25%、40%。

图灵家族三大核心与帕斯卡家族大核心GP102对比。

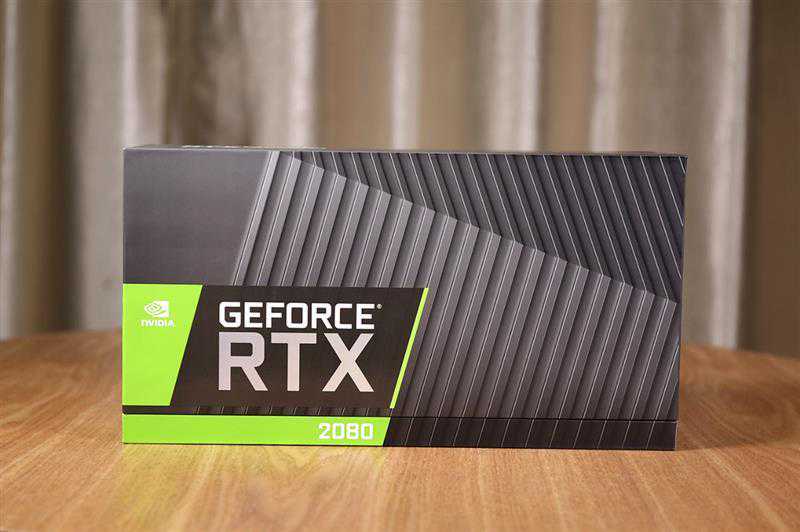

八、图赏:16相数字供电售价万元的双风扇“煤气灶”

以下是RTX2080的图赏。

RTX2080包装盒。

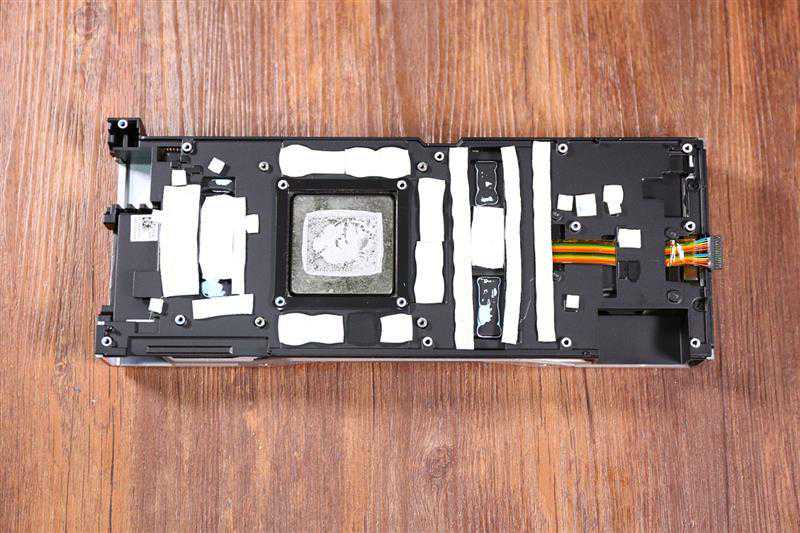

公版RTX2080显卡的外观有了巨大的变化,放弃以往的涡轮散热,转而采用开放式双风扇设计,加上银色金属机身,看起来像极了“煤气灶”。

一块巨大的全覆银色金属背板,背板厚度达到了3mm,具有良好的散热效果。

8+6PIN的供电输入,可以提供350W的输入功率。

抛弃了传统的SLI接口,采用了第二代NVIDIANVLink高速互联方案,能提供100GB/s的双向带宽,并且大大降低了延迟。

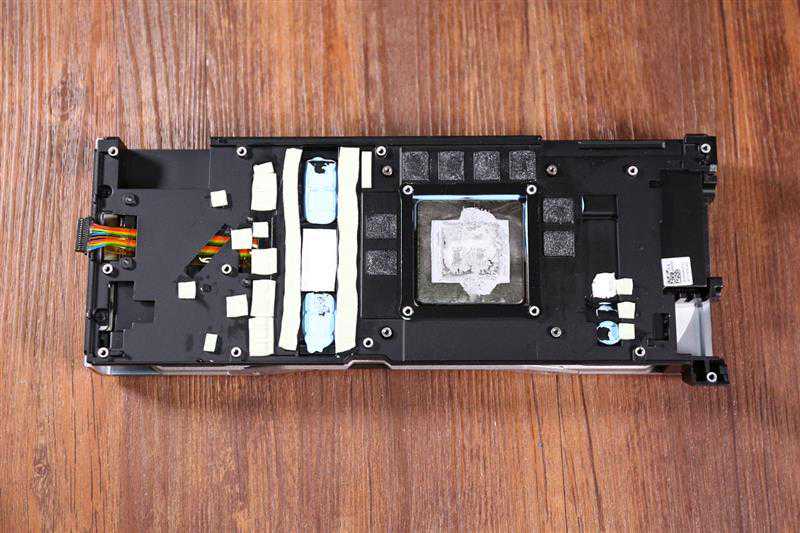

拆开扇热器后的PCB本体,RTX2080采用TU104核心,拥有136亿晶体管,几乎2倍于GTX1080。显存采用的美光GDDR614000MHz,单颗1GB,一共8颗组成256Bit8GB,显存带宽达到了448GB/s。

供电部分采用了8相核心+2相显存的供电方案,并且大量采用了高端的钽电容,供电规模及用料远远超过了公版的GTX1080(6+1相供电)。

散热器可以完美贴合PCB上每一个发热的元件,显卡不会出现某个部分温度过高的情况。

以下是RTX2080Ti的图赏。

RTX2080Ti包装盒。

与RTX2080一样,RTX2080Ti也同样舍弃了以往的涡轮散热,转而采用双风扇设计,看上去就是一个价值一万元的煤气灶。

银色全覆金属背板,也同样是和RTX2080一样,没有什么区别。

双8Pin供电,最高能提供400W的收入功率。

同样采用了第二代NVIDIANVLink高速互联方案。

RTX2080Ti采用TU102核心,拥有189亿晶体管。

显存采用的美光GDDR614000MHz,单颗1GB,一共11颗组成352Bit11GB,显存带宽达到了616GB/s。

供电部分则采用了14+2一共16相供电方案,顶级非公都很难达到这样的规模,看来售价万元的显卡在用料方面果真是舍得下本钱。

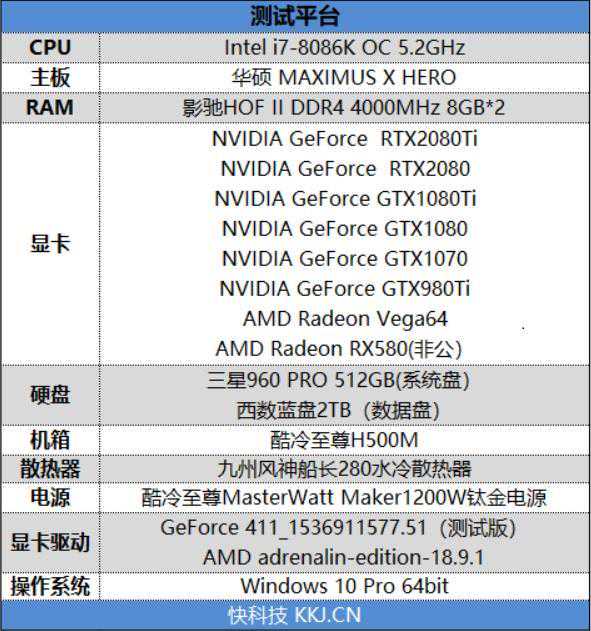

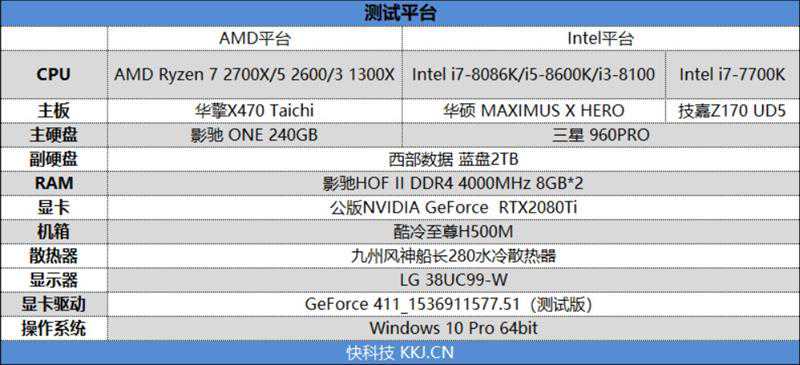

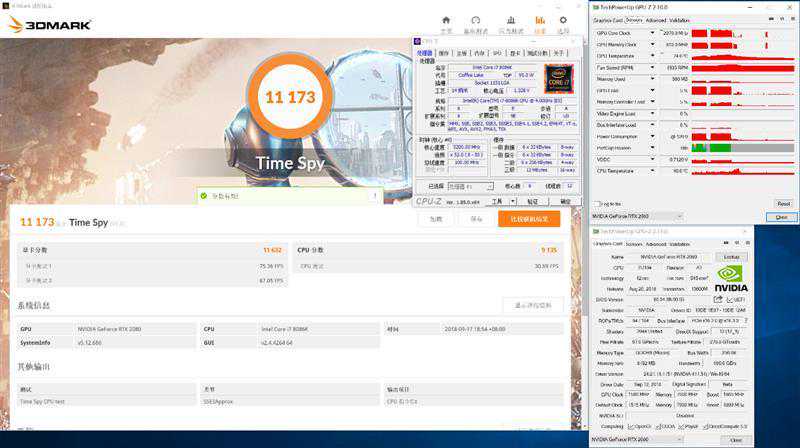

九、测试平台:5.2GHz的i7-8086K助阵

测试平台如下:

最新的已经可以准确识别RTX2080、RTX2080Ti。

i7-8086K基于八代酷睿CoffeeLake构架,14++纳米工艺制造,核心面积约150平方毫米,拥有六个核心十二线程,睿频加速达5GHz,这是Intel史上第一颗默认能跑到5GHz频率的处理器。

为了尽可能的发挥RTX2080Ti强大的性能,我们将此U超频到了5.2GHz。

主板选用了华硕MAXIMUSXHERO,拥有高达10相超合金数字供电,超频能力在Z370主板中属于顶级水准。BIOS已经更新到最新版本。

内存使用了影驰HOFIIDDR4-40008GBx2套装,测试中开启XMP保持4000MHz频率,时序为19-25-25-45CR2。

机箱采用了酷冷至尊顶级的H500M型号,其前置双200mm风扇以及大面积的金属散热孔能够将机箱内部热量快速排出,有效降低电源和硬盘的温度。

机箱背部的金属铠甲将背线打理的井井有条,看上去十分干净。

我们采用的显示器是LG38UC99,其支持的最高分辨率为3840X1600,测试中的4K分辨率就是指的这个。

测试平台使用的是酷冷至尊MasterWattMaker1200W钛金电源。

MasterWattMaker1200W是目前顶级的双路电源,转换效率高达93%。双路12V输出,每路限流50A即600W的功率。

MasterWattMaker1200采用的是全模组设计,不同功能的模组接口都有着不同的外形,以防止玩家误接。

为了压制5.2GHz的i7-8086K,散热器采用了九州风神顶级的船长280一体水冷散热器。

十、1080P分辨率测试:RTX2080碾压帕斯卡全系处理器开始瓶颈

Turing的核心构架完全不同于以往的产品,从Kepler到Maxwell到再到Pascal,每一个CUDA核心都就是由FP32单元构成。

而Turing每一个CUDA核心除了有一个FP32的单精度浮点单元之外,还有一个INT32的单精度整数单元。每8个CUDA单元搭配一个TENSOR核心,64个CUDACORE+8个TENSORCORE再加上一个RTCORE构成一组SM(其实每一组SM中还有2个FP64双精度浮点单元,只是下图并没有标示出来)。

根据NVIDIA的说法,INT32可以为每个CUDA核心带来36%的性能提升,再加上L1缓存带宽的成本增加以及降低延迟,最终图灵每个CUDA核心相比帕斯卡能有50%的性能提升。

图灵是否真如所说还是需要具体的测试来验证,下面正式进入游戏测试环节。

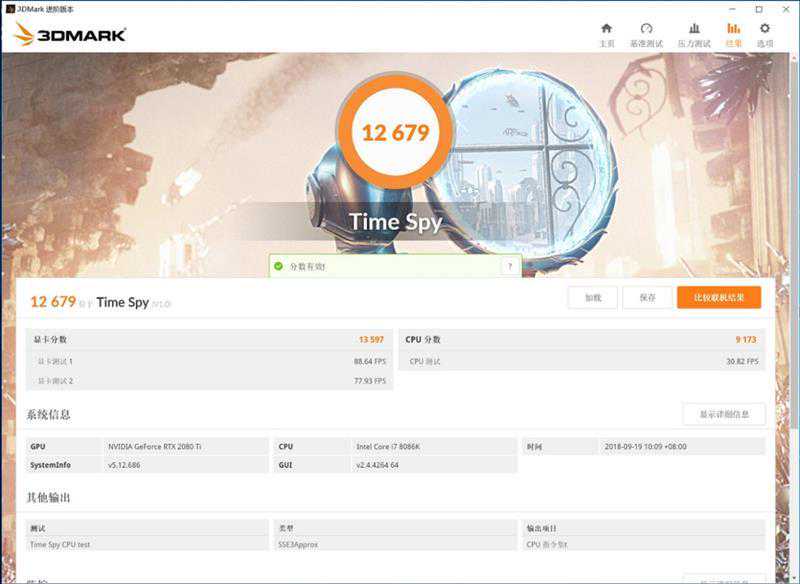

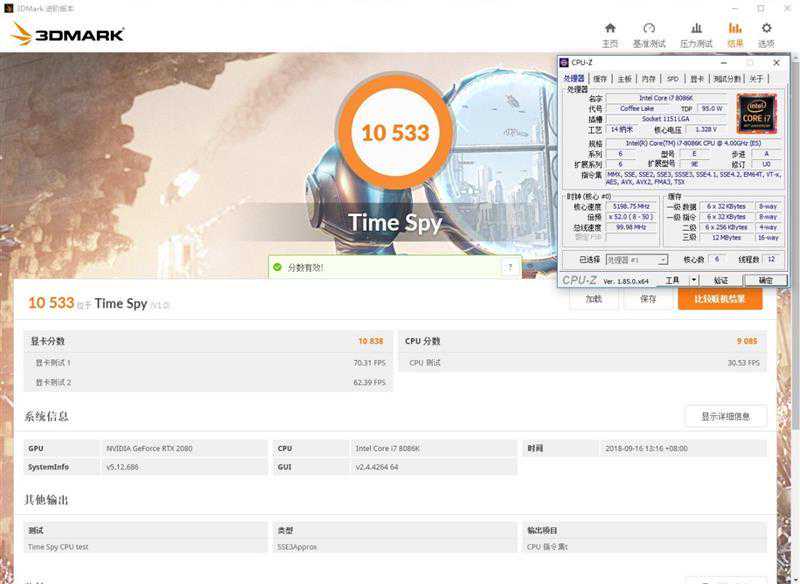

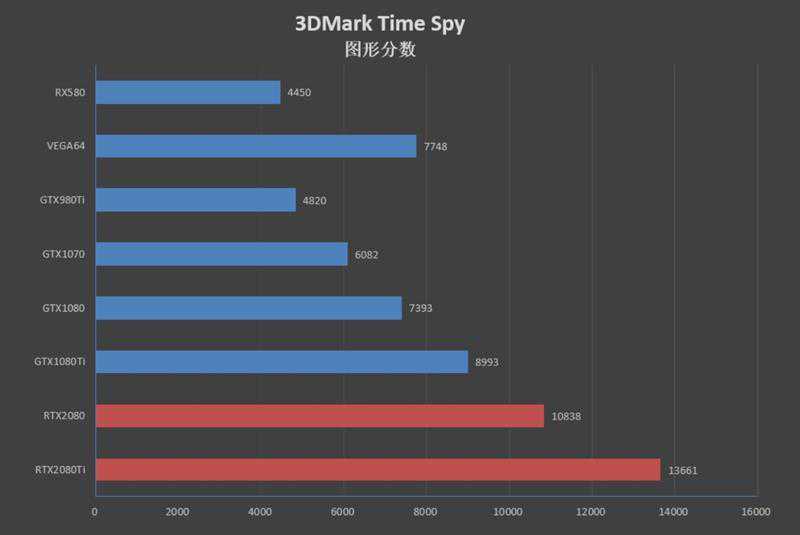

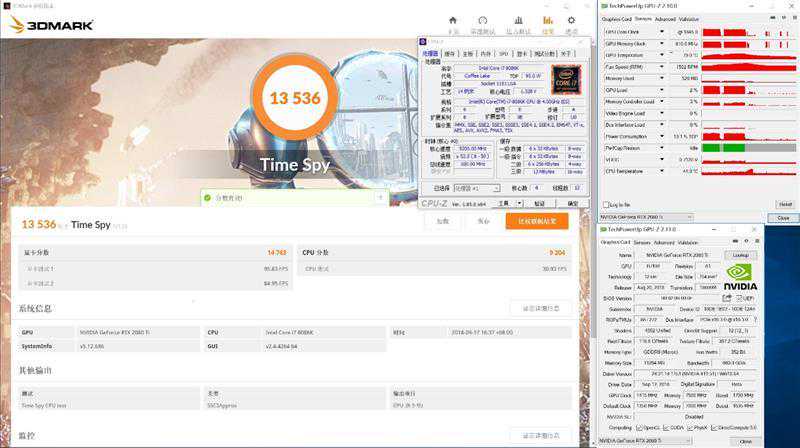

3DMarkTimeSpy

RTX2080Ti的3DMarkTimeSpy跑分,图形分数达到了13597。

RTX2080Ti的3DMarkTimeSpy跑分,图形分数达到了10838。

在3DMarkTimeSpy测试中,RTX2080超越了GTX1080Ti,领先了20%,相比GTX1080的7393分则提升了46%之多。

RTX2080Ti比GTX1080Ti提升了52%。

3DMarkFireStrikeExtreme

2013年诞生的3DMarkFireStrike其实已经不再适合充当最新显卡的测试工具,RTX2080的表现不如GTX1080Ti,有500分的差距,但是依然比GTX1080强了22%。

RTX2080Ti相比GTX1080Ti有21%的提升。

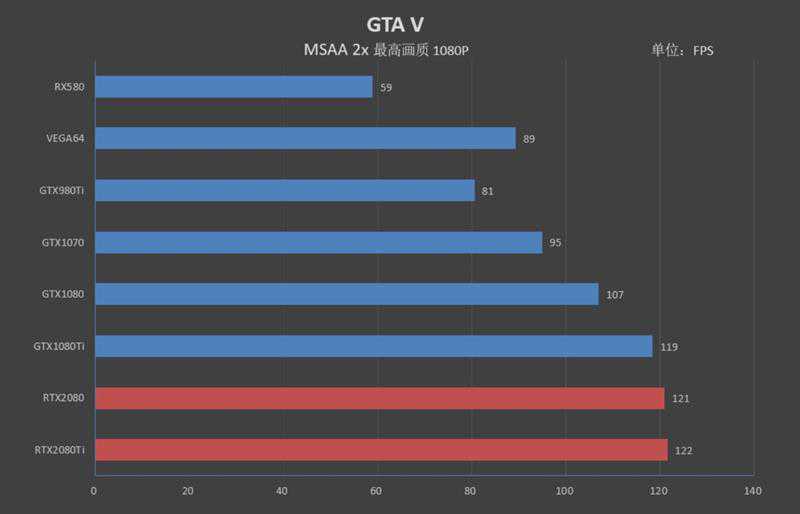

GTAV

《GTAV》于2015年登陆PC平台,全平台的销量已经超过了1亿,算是10年来最成功的单机大作,现在依然人气不减。

画质手动调为最高特效,开启MSAA2X以及NVIDIATXAA,分辨率为1920x1080,显存占用3422M。

1080P分辨率下受制于CPU性能瓶颈,RTX2080Ti与RTX2080帧数几乎一样,比GTX1080Ti只有2帧的优势,比起GTX1080多了14帧。

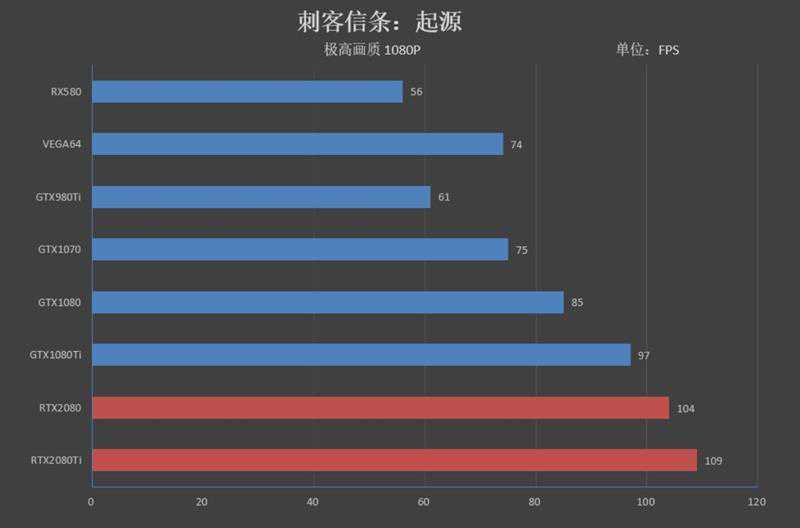

刺客信条:起源

《刺客信条:起源》是由育碧制作并发行的《刺客信条》系列历史上规模最大的一个。本作采用开放地图沙盒玩法,游戏几乎呈现了整个古埃及王国,画质与风景无人能出其右。

测试时开启极高画质,分辨率为1920x1080。

图灵的2张显卡都过了100帧,RTX2080领先GTX108019帧,RTX2080Ti比GTX1080Ti多了12帧。

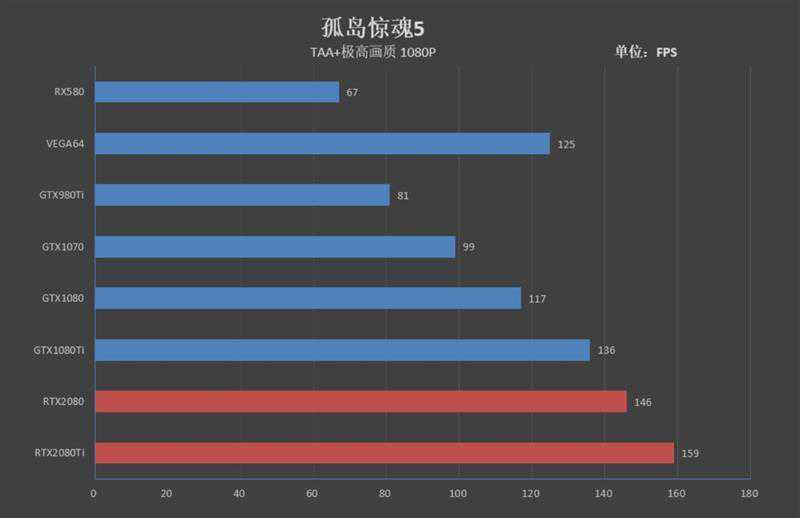

孤岛惊魂5

《孤岛惊魂5》是一款由育碧(Ubisoft)制作的第一人称射击游戏。已于2018年3月正式发售。

在《孤岛惊魂5》中,RTX2080Ti领先GTX1080Ti23帧,RTX2080领先GTX108029帧。

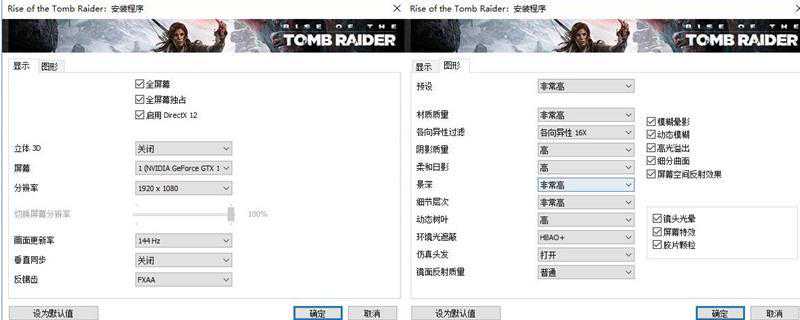

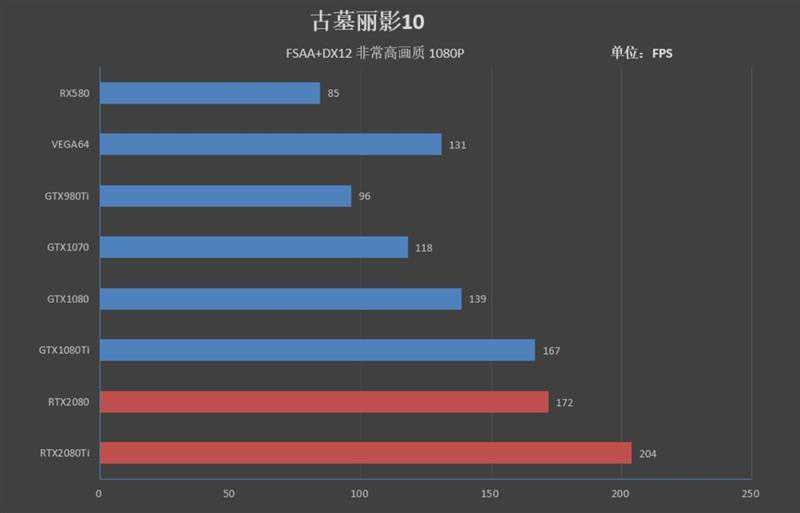

古墓丽影10

画面设置为1920*1080FXAA、DX12+默认非常高画质。

RTX2080Ti帧数达到了204,领先GTX1080Ti32帧这是第一次有显卡能在1080P最高画质下跑出200+的帧数。RTX2080领先GTX108033帧。

GTX980Ti在进行此项测试时,若选择DX12模式,帧数会爆降30%,因此该卡是以DX11进行的游戏测试。

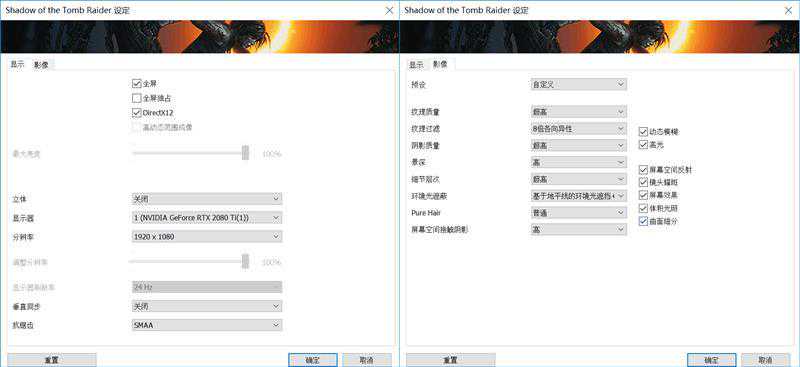

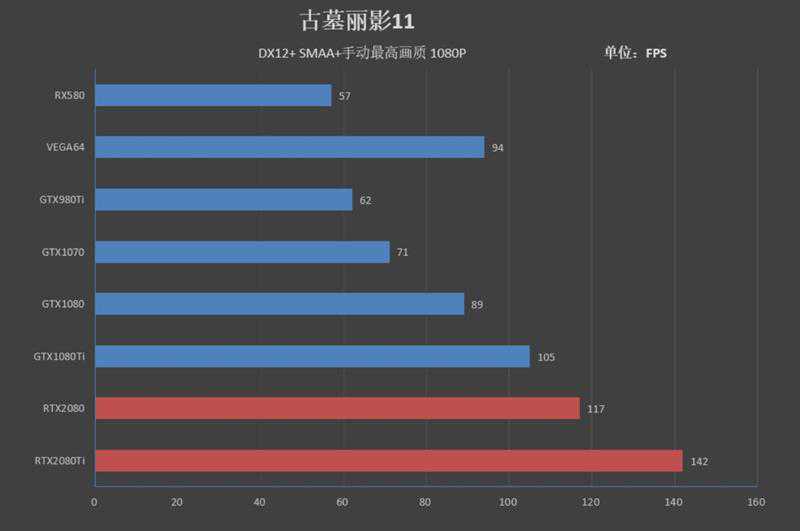

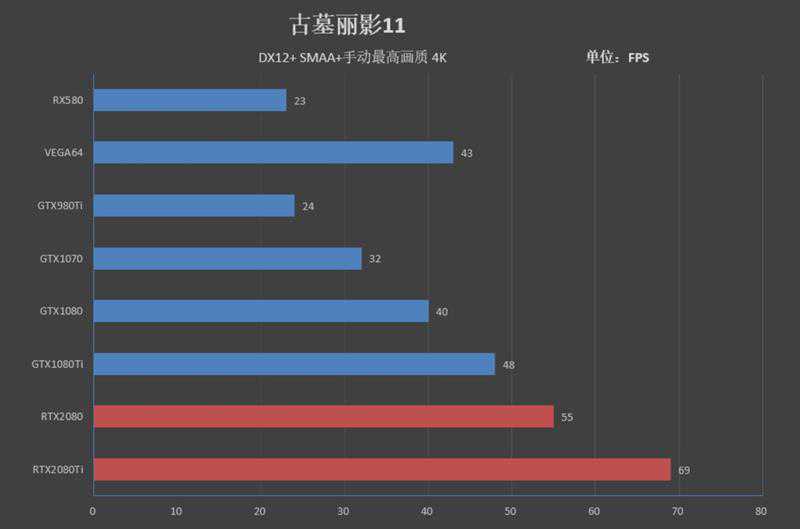

古墓丽影11

《古墓丽影:暗影》是一款由EidosMontreal工作室制作的动作冒险游戏,本作是重启版《古墓丽影》的系列第三作,已于2018年9月15日正式发售。该游戏在后续的补丁中将提供对RTX系列显卡DLSS与光线追踪技术的支持。

画面设置为1920*1080FXAA、DX12+手动最高画质。

在古墓丽影11中,RTX2080Ti跑出了142帧,领先GTX1080Ti37帧。

RTX2080也有117帧,比GTX1080多了28帧。

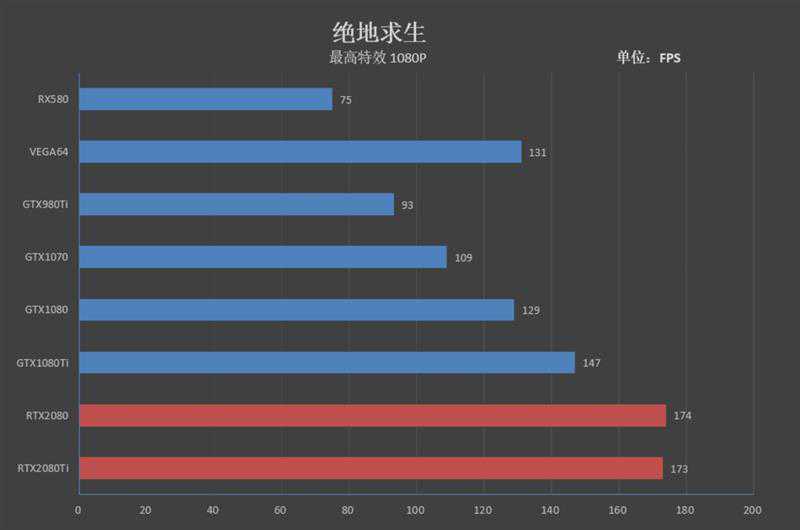

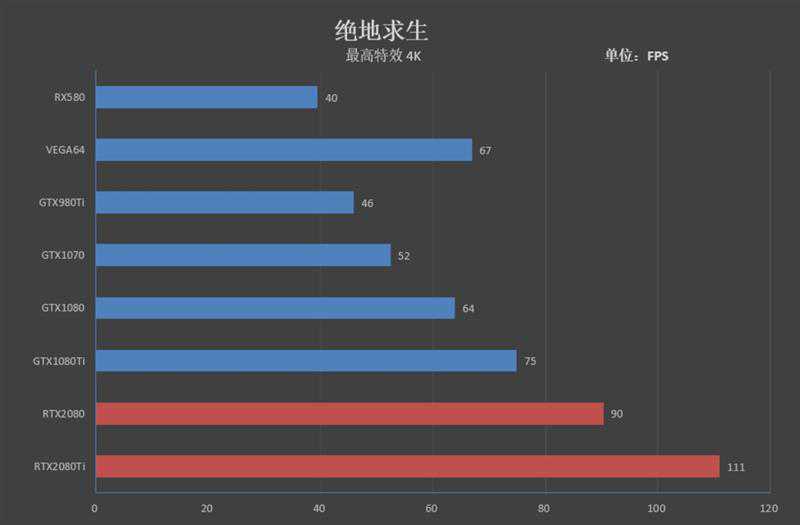

绝地求生

虽然已经发售了一年之久,《绝地求生》依然是目前最火的PC游戏,经过蓝洞工作室数次优化,现在已经能较为完善的支持6核处理器。

由于本游戏没有提供测试程序,我们选在训练场中选择了一块无人场地,反复进行多次帧率测试,确认每次得到的结果差距都在2%以内。

受制与CPU性能,RTX2080Ti与RTX2080跑出了同样的帧数,相比GTX1080Ti领先了27帧,比起GTX1080则有45帧的优势。

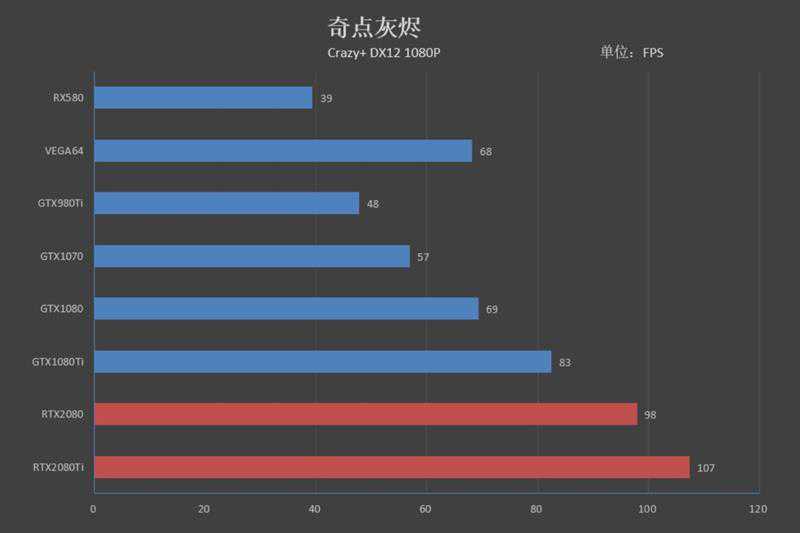

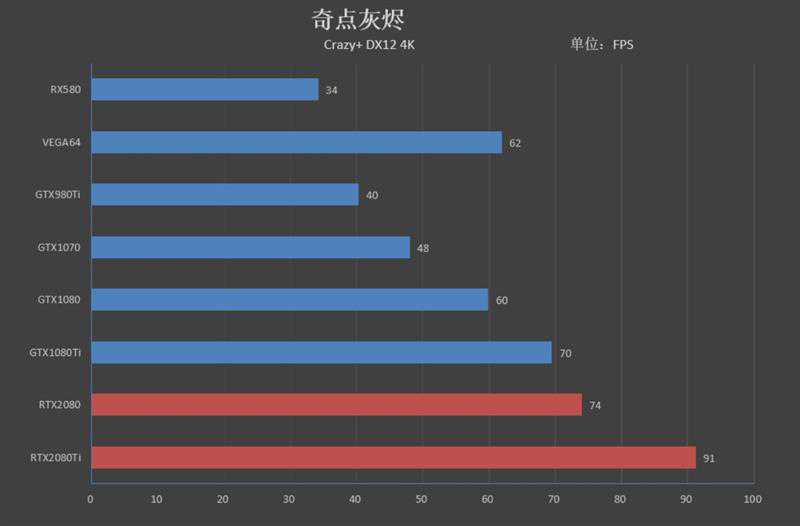

奇点灰烬

《奇点灰烬》作为一个老牌的PC游戏测试项目,目前已经优化了8核处理器支持,它对处理器和显卡的要求都非常高。

测试时选择Crazy画质、DX12模式、分辨率为1080P

在《奇点灰烬》中,RTX2080Ti跑出了107帧,领先GTX1080Ti25帧。

RTX2080也有98帧,领先GTX1080Ti15帧,领先GTX108029帧。

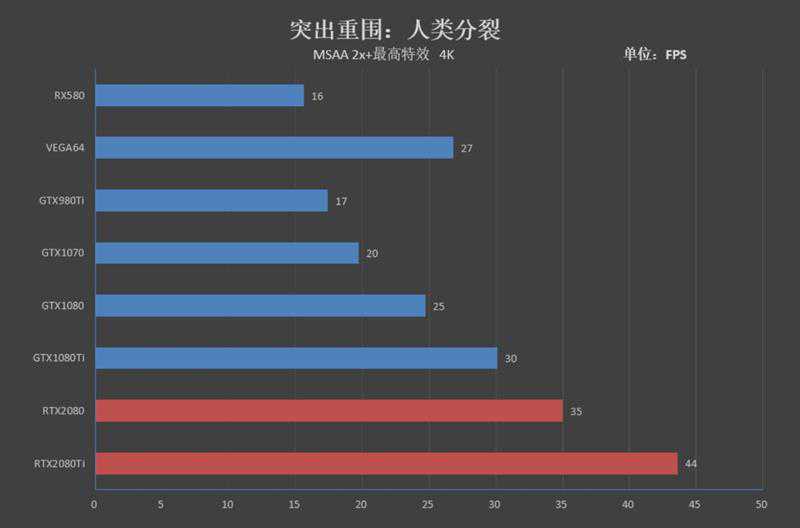

突出重围:人类分裂

《杀出重围:人类分裂》是SquareEnix为PS4开发的次世代FPS类游戏,该游戏是目前所测试游戏中对显卡性能要求最高的一款。测试时画质

RTX2080Ti帧率为93FPS,领先GTX1080Ti25帧。RTX1080则有74帧,领先GTX1080Ti19帧。

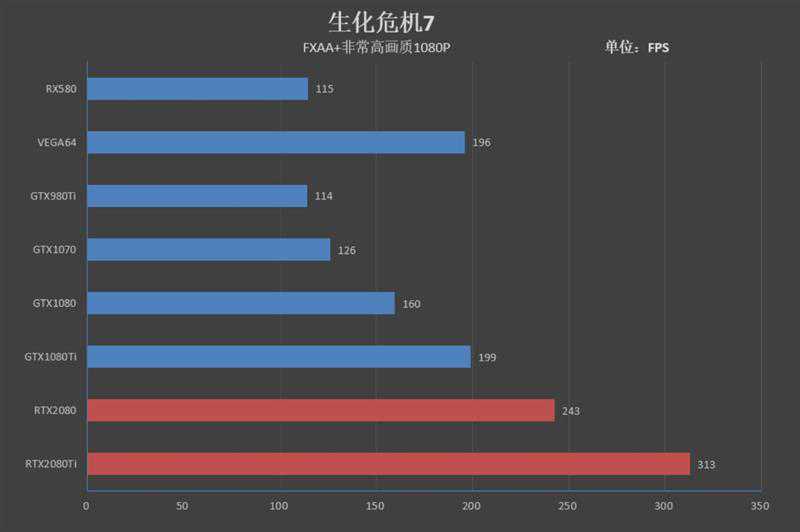

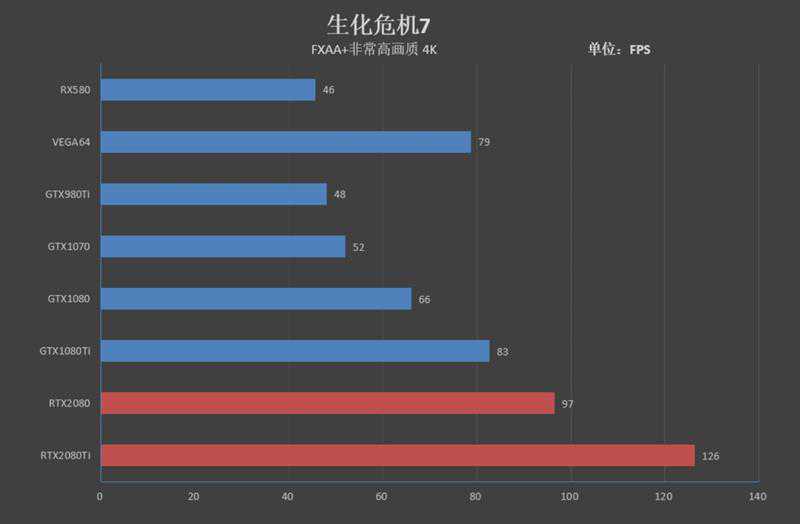

生化危机7

《生化危机7》是卡普空制作的生存恐怖类游戏《生化危机》数字编号系列第八部,有着全新的恐怖求生体验,玩家的视觉切换为更骇人的虚拟实境“隔离视觉”模式,写实感提升至一个全新的境界。

游戏的测试方式为从开局下车地点走到教堂门口,记录20秒帧数。

《生化危机7》对CPU性能没有太高要求,在1080P最高画质下,RTX2080Ti跑出了了313FPS的高帧率,领先GTX1080Ti将近60%。

RTX2080也有243帧,领先GTX1080Ti44帧,比GTX1080快了83帧,领先幅度也有51%。

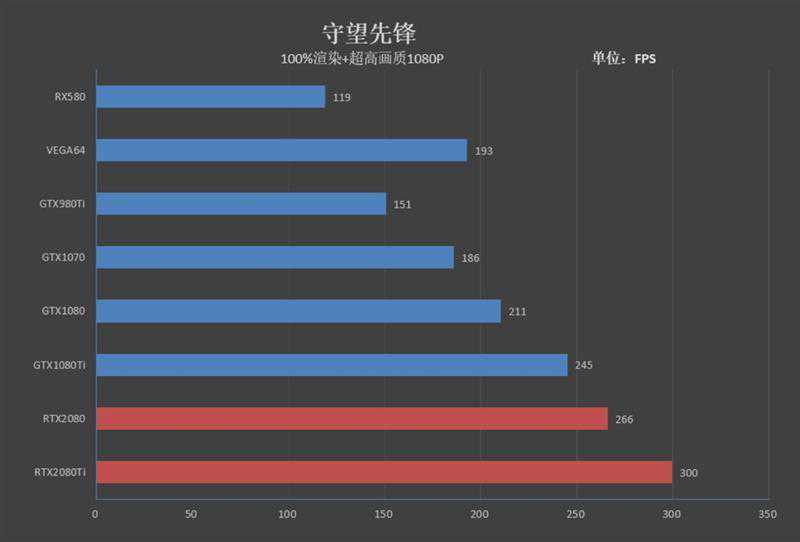

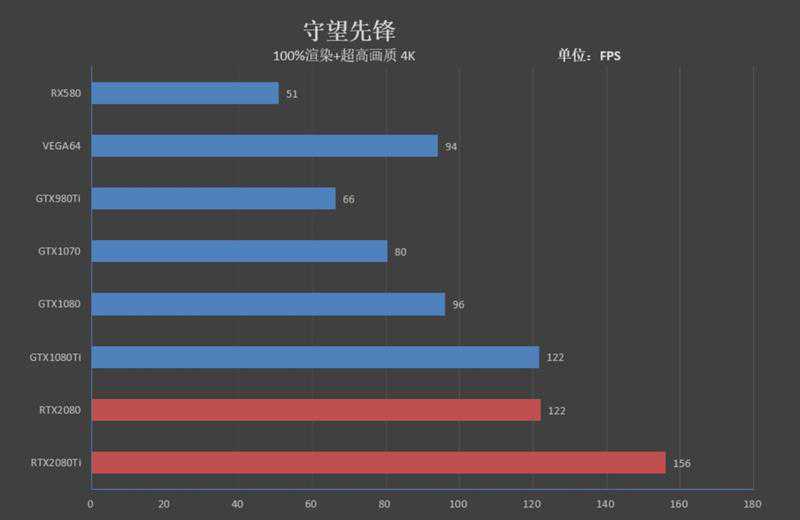

守望先锋

《守望先锋》暴雪娱乐第一次涉足FPS领域的作品,2016年曾经火爆全球,影响力一度超过了LOL,即便是现在仍然还有相当数量的玩家活跃在游戏中。

由于游戏没有提供测试程序,我们选在训练关卡中从出生地一直向前奔跑,用Fraps记录20秒帧数。测试时打开10

《守望先锋》游戏内锁死了300帧,所以RTX2080Ti最多也就能跑到300帧,相比GTX1080Ti领先了55帧。

RTX2080成绩为266帧,领先GTX1080同样也是55帧。

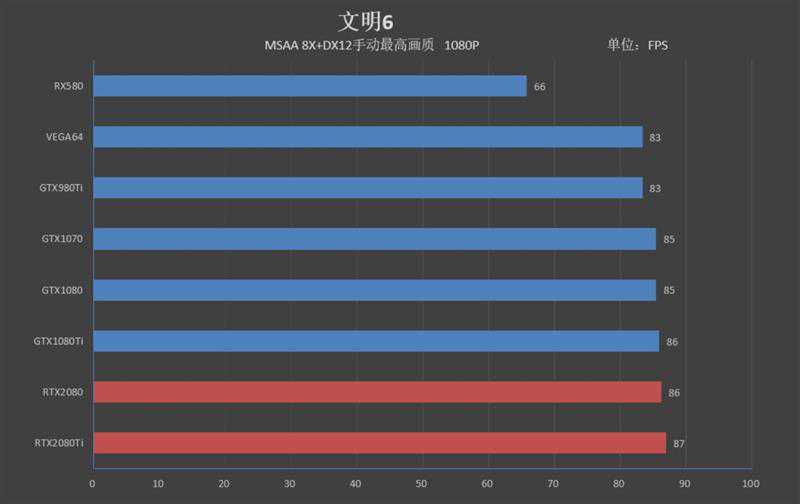

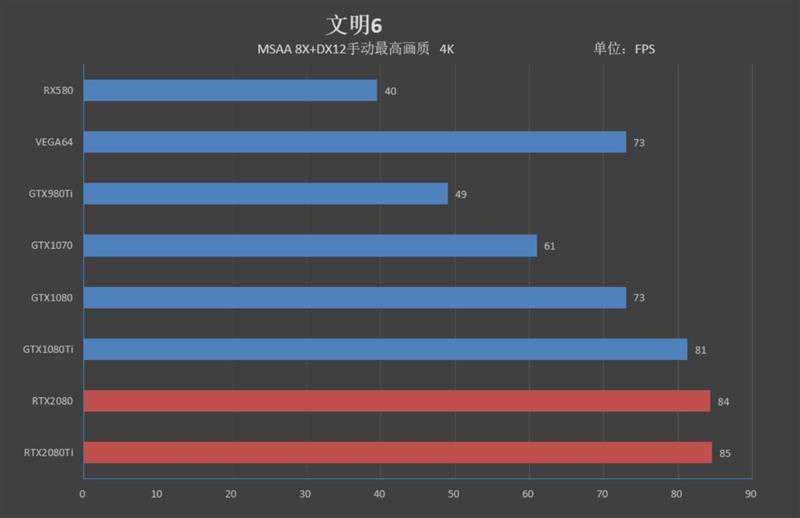

文明6

《文明6》是由FiraxisGames开发,2KGames负责发行的策略类游戏,该游戏是游戏设计师席德·梅尔创作的《文明》系列的第6部。

测试时选择最高画质,并将所有材质分辨率调到最高。

《文明6》也是一款几度需求CPU性能的游戏,除了RX580之外,其他几款显卡帧数都没有多少区别,最强的RTX2080Ti也就比GTX980Ti快了不到5%。

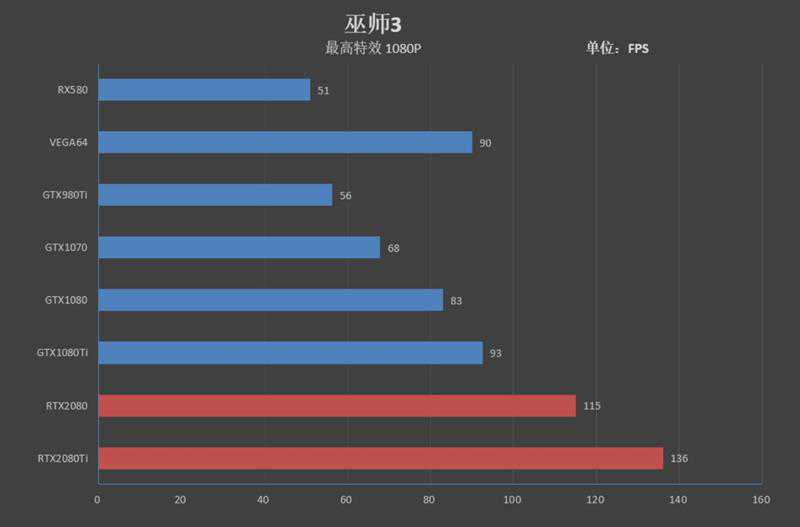

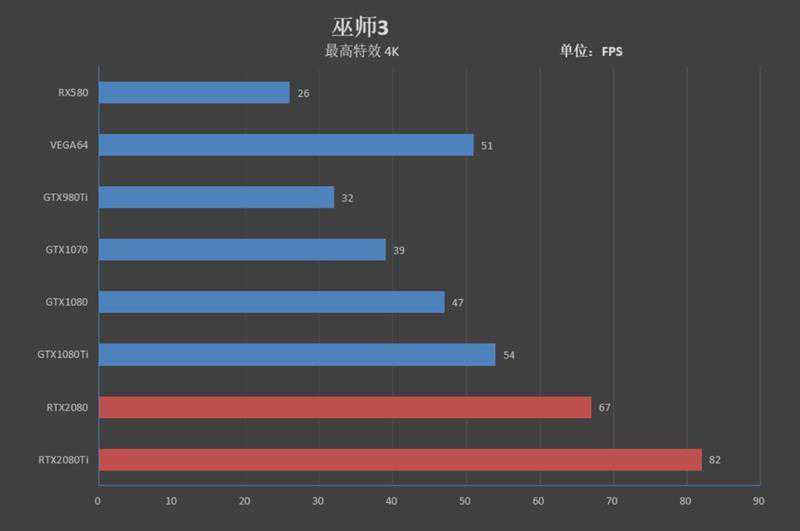

巫师3

《巫师3》为《巫师》系列游戏作品的第三部,也是杰洛特冒险的终曲。层获第33届金摇杆奖最佳剧情、最佳视觉设计、最佳游戏时刻,更获得IGN2015年度最佳游戏。

游戏内没有提供测试程序,测试场景选在一处山坡,测试时骑马直线奔驰,用Fraps记录20秒帧数。

在1080P最高画质下,RTX2080Ti跑出了136帧,比GTX1080Ti快了43帧,领先幅度将近50%。

RTX2080帧数为115FPS,领先GTX108032帧。

中土世界:战争之影

在最高画质下,同时开启TAA抗锯齿,RTX2080Ti能跑出160FPS的帧率,领先GTX1080Ti39帧,

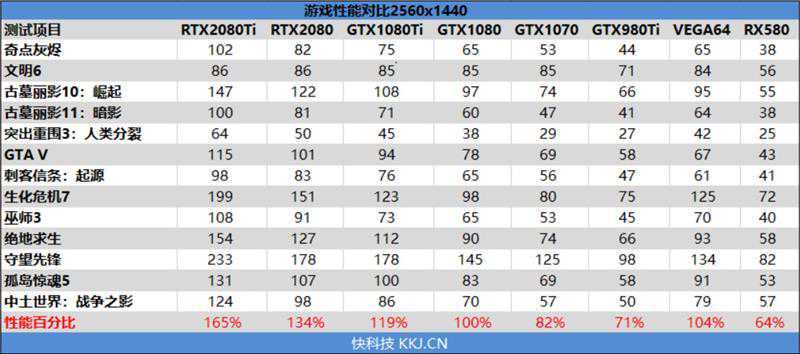

十一、2K分辨率测试:新构架威力进一步显现

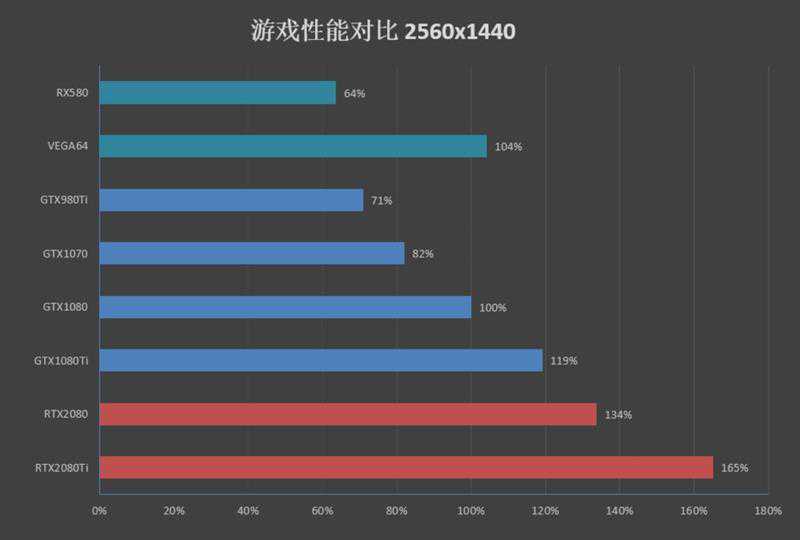

本来2K分辨率测试不在计划之内,考虑到现在不少玩家都用上2K分辨率显示器,临时决定将此分辨率加入测试。

由于文明6过于依赖CPU性能,GTX1070以上的显卡都没有跑出差距,在计算性能百分比时并未加入此游戏的数据。

在2560x1440分辨率下,RTX2080Ti的性能稍稍得以施展,相比GTX1080领先幅度达到了65%,比GTX1080Ti则快了39%。

RTX2080相比GTX1080领先幅度达到了34%,比GTX1080Ti也快了13%。

麦克斯韦年代的旗舰GTX980Ti与GTX1070的性能进一步拉开,仅能达到后者86%的性能。

AMD这边的期间显卡VEGA64稍强与GTX1080,领先幅度为4%。

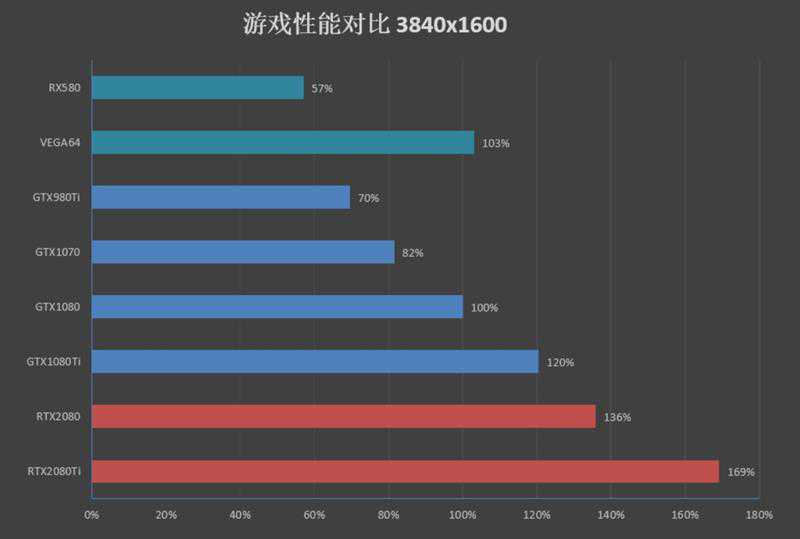

十二、4K分辨率测试:高端显卡的主战场图灵得以一展雄风

对于RTX2080Ti这种级别的显卡而言,只有4K分辨率才能真正榨干它全部的性能,低分辨下进行测试时,由于CPU本身在渲染建模方面无法跑出太高帧率,RTX2080Ti的性能难以完全发挥。

我们采用的显示器是LG38UC99,测试的分辨率为3860X1600,与标准的3840X2160的4K分辨率有些许差异。测试时的画面设置与1080P相同,不再一一赘述。

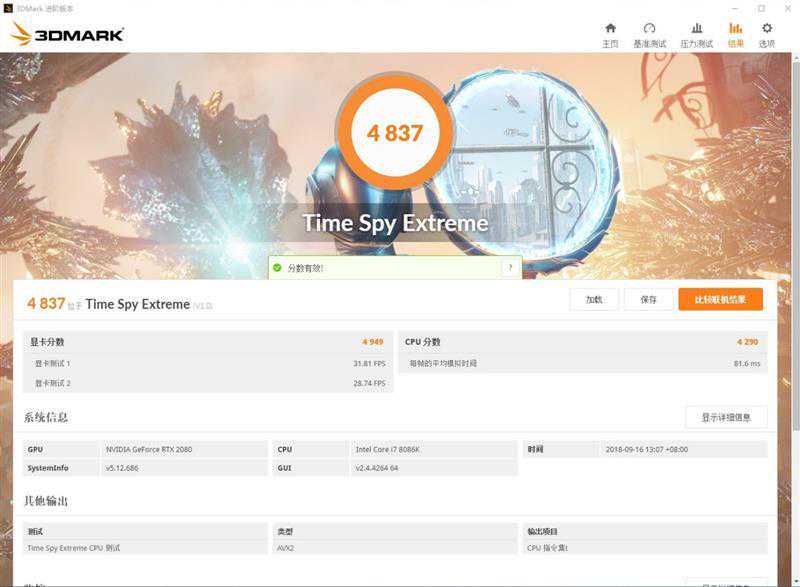

3DMarkTimeSpyExtreme

RTX2080的3DMarkTimeSpyExtreme跑分,图形分数达到了4949。

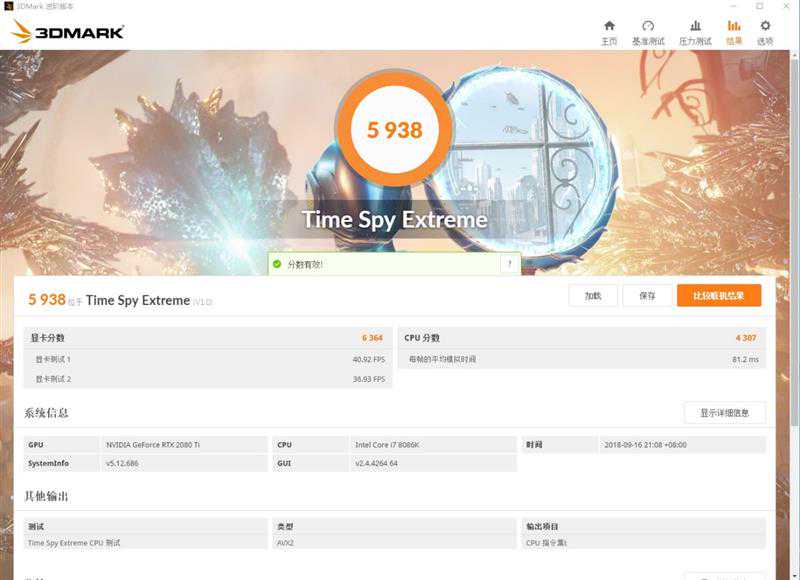

RTX2080Ti的3DMarkTimeSpyExtreme跑分,图形分数达到了6364。

在3DMarkTimeSpy测试中RTX2080跑分比GTX1080Ti高了761分,领先幅度为18%,相比GTX1080的3314分则提升了50%之多。

RTX2080Ti比GTX1080Ti提升了52%。

3DMarkFireStrikeUltra

3DMarkFireStrikeUltra现在无法反应图灵的真实性能,此项测试中RTX2080要落后GTX1080Ti大概4%,但在所有其他的游戏测试中,RTX2080都是大幅度领先GTX1080Ti,无一例外。

RTX2080Ti在此项测试中的得分为7907,领先GTX1080Ti1446分。

RTX2080得分则为6225,领先GTX10801035分。

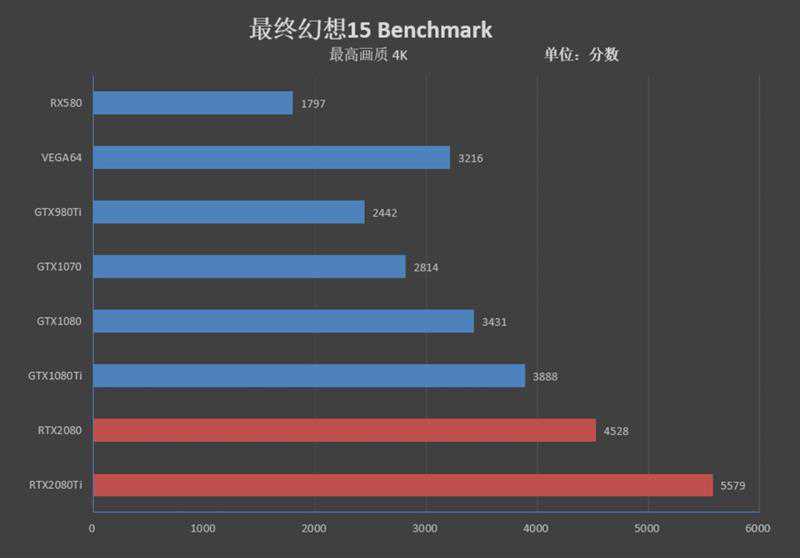

最终幻想15

《最终幻想15》是SquareEnix史上最昂贵的游戏开发项目,历时10年的开发周期。本作是《最终幻想》系列中最接近“水晶的神话”的核心内容的一部,向玩家呈现了一个广大而又开放的世界

RTX2080Ti跑出了5579的分数,领先GTX1080Ti1691分,领先幅度为43%。

RTX2080的分数为4528,领先GTX1080Ti16%,相比GTX1080领先幅度有32%。

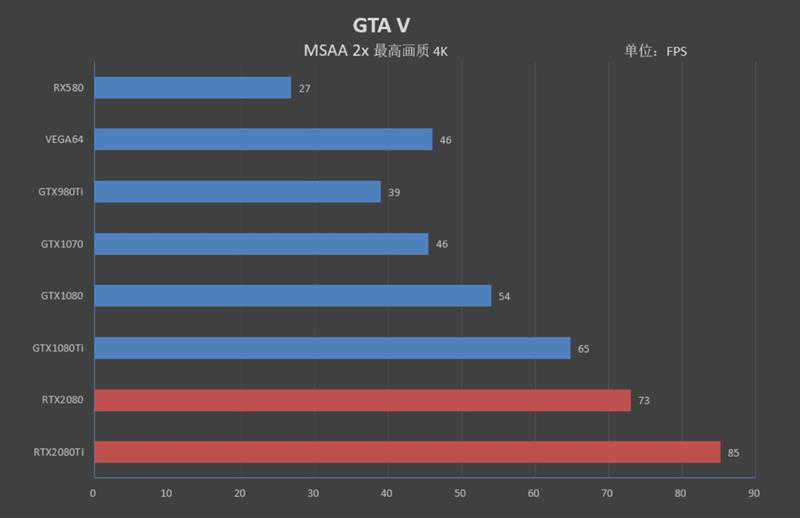

GTAV

RTX2080Ti帧率为85FPS,领先GTX1080Ti20帧。

RTX2080帧率为73FPS,领先GTX108018帧。

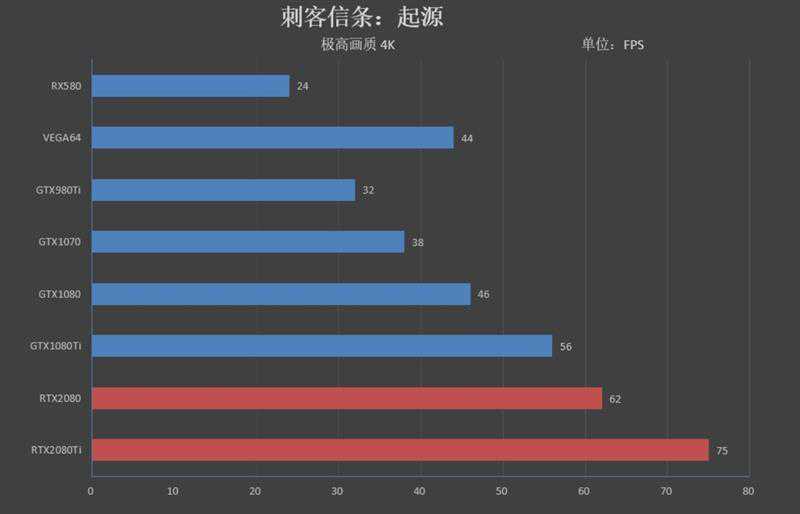

刺客信条:起源

在《刺客信条:起源》测试中,RTX2080Ti帧率为75FPS,领先GTX1080Ti帧。

RTX2080帧率为62FPS,领先GTX108016帧。

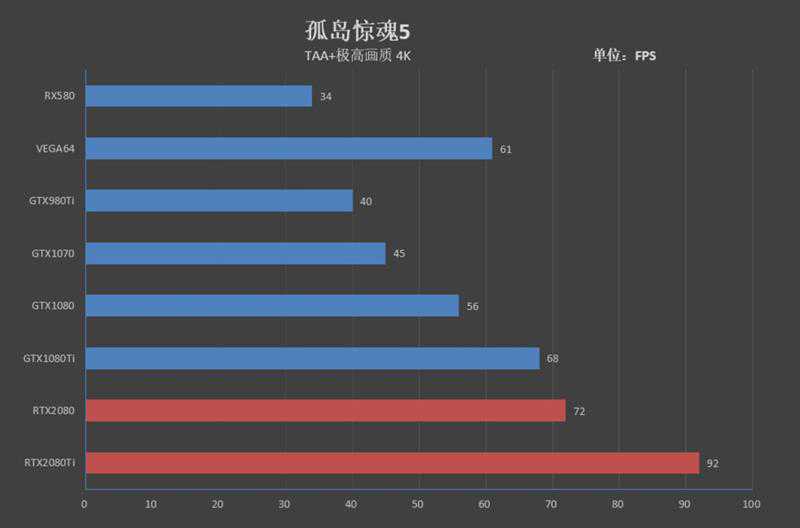

孤岛惊魂5

在《孤岛惊魂5》测试中,RTX2080Ti跑出了92FPS的帧率,领先GTX1080Ti24帧。

RTX2080帧率为72FPS,领先GTX1080Ti16帧。

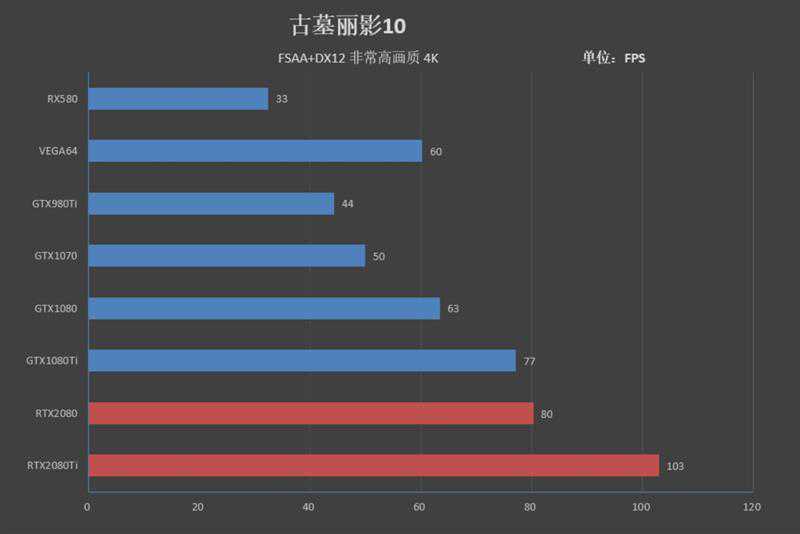

古墓丽影10

RTX2080Ti的帧率为103FPS,领先GTX1080Ti26帧。

RTX2080帧率为80,领先GTX108017帧。

古墓丽影:暗影

RTX2080Ti帧率为69FPS,领先GTX1080Ti21帧。

RTX2080帧率为55FPS,领先GTX108015帧。

绝地求生

4K分辨率下,RTX2080Ti在《绝地求生》中也能跑出111FPS的帧率,领先GTX1080Ti36帧。

RTX2080的帧率为90,领先GTX108026帧。

奇点灰烬

在《奇点灰烬》的测试中,RTX2080Ti跑出了91FPS的帧率,领先GTX1080Ti21帧。

RTX2080的帧率则为74FPS,领先GTX108014帧。

突出重围:人类分裂

RTX2080Ti的帧率为44FPS,领先GTX1080Ti14帧。这是RTX2080Ti唯一没有达到60FPS的游戏。

RTX2080的帧率为35FPS,领先GTX10805帧。

生化危机7

在《生化危机7》的测试中,RTX2080Ti的帧率为126FPS,领先GTX1080Ti43帧,领先幅度为52%。

RTX2080的帧率为97FPS,领先GTX108031帧,领先幅度为47%。

守望先锋

RTX2080Ti的帧率为156FPS,领先GTX1080Ti34帧。

RTX2080的帧率则为122FPS,领先GTX108016帧。

文明6

在4K分辨率下,GTX1080Ti以下的显卡终于扛不住了,各种差距开始拉开,然而RTX2080与RTX2080Ti性能仍未完全发挥,帧率与1080P分辨率完全一样。

巫师3

在《巫师3》中,RTX2080Ti的帧率为82,领先GTX1080Ti28帧,领先幅度为52%

RTX2080的帧率为67,领先GTX108020帧,

4K分辨率的测试数据汇总如下:

由于文明6过于依赖CPU性能,3DMarkFireStrikeUltra的跑分无法反应图灵性能,在计算性能百分比时并未加入这2个项目的测试数据。

在4K分辨率下,RTX2080Ti的性能得以释放,相比GTX1080领先了69%,和GTX1080Ti相比,有41%的领先幅度。

RTX2080相比GTX1080有36%的领先幅度,和GTX1080Ti相比,也能领先13%。

VEGA64的表现甚至不如2K分辨率,对GTX1080的领先优势只剩下3%。

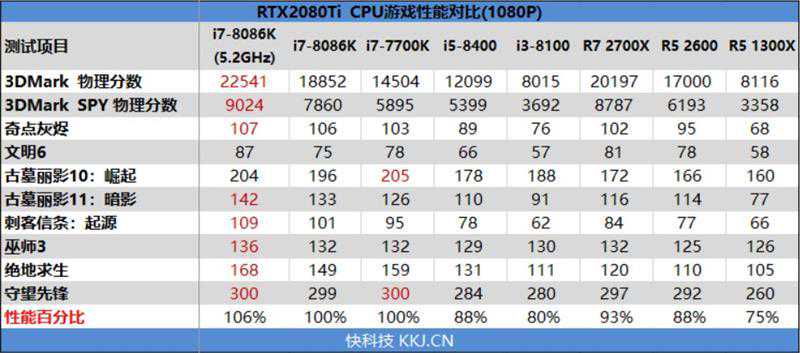

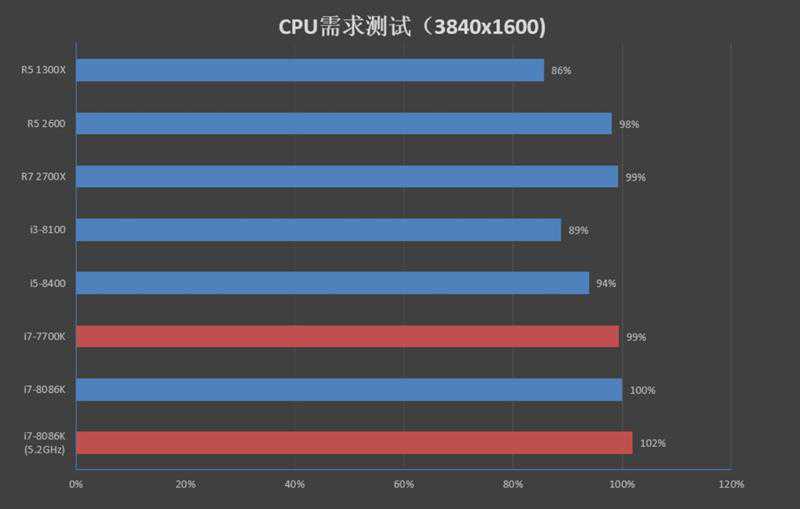

十三、CPU需求测试:4核4线程处理器无法胜任i7-7700K老当益壮

在7代酷睿年代,很多玩家觉得4核i5与顶级的4核i7处理器相比,在单机游戏上面方面没有多少差异,为此我们收集了7款主流的CPU逐一测试,方便玩家了解顶级显卡对CPU性能的需求。

1、测试平台

因为AMD平台无法支持4000MHz频率内存条,测试时内存统一采用3200MHz频率

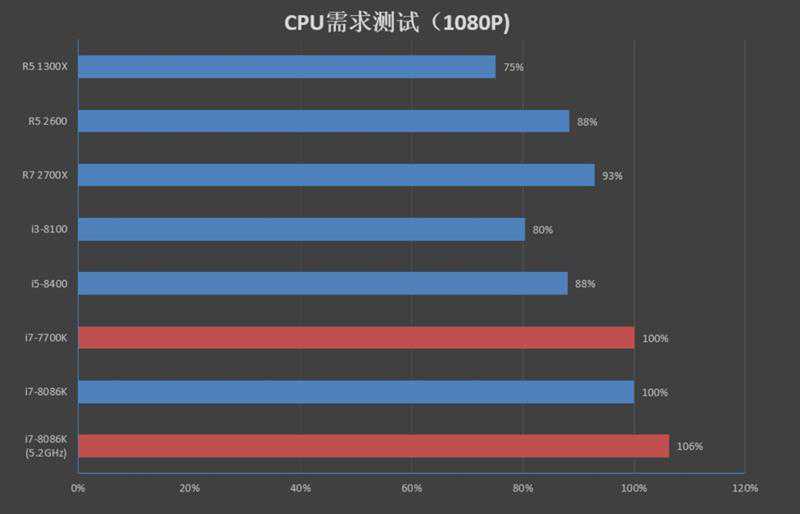

2、1080P分辨率测试

以下是1920x1080分辨率下7款CPU的测试成绩汇总:

在1080P分辨率下,各种档次的处理器跑出来的游戏帧数差别明显,特别是没有超线程功能里处理器严重限制了RTX2080Ti的性能。在多款游戏中,R51300X与i3-8100与顶级处理器之间都有超过50%的差距。

I7-7700K老当益壮,游戏性能与默频的8086K几乎完全一样,如果手上还有7700K的同学,想要购买RTX2080级别的显卡,可以不用升级处理器。4核4线程的R31300X和I3-8100完全无法发挥RTX2080Ti的性能。超频到5.2GHz的8086K比默频时提升了6%的帧数。

3、4K分辨率测试

以下是3840x1600分辨率下7款CPU的测试成绩汇总:

4K分辨率最高特效下,压力都在显卡这一边,除了《奇点灰烬》和《文明6》这2款比较吃CPU的游戏之外,其他游戏游戏的测试中,各款CPU的帧数差距并没有很大。

在4K分辨率下,8086K、7700K、2700X、2600在处于同一档次,6核6线程的I5-8400与前面几款产品有6%的差距,R31300X和I3-8100这2款处理器落后的幅度没有1080P那么明显,但也有10%以上的差距。

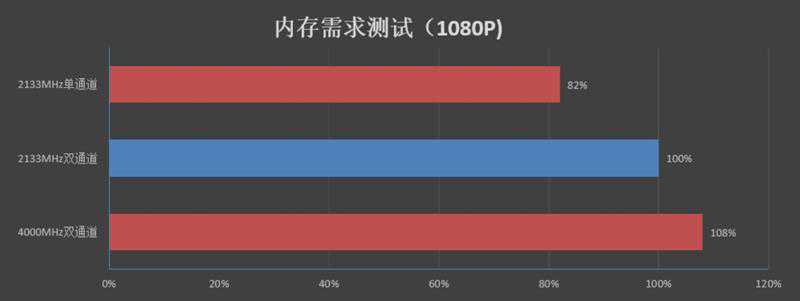

4、内存需求测试:

分别测试2133MHz单通道、2133MHz双通道、4000MHz双通道三种状态下,RTX2080Ti的游戏帧数,内存容量16GB。测试数据如下:

由上表可以看出,2133MHz单通道已经完全不能满足RTX2080Ti的需求,比双通道时普遍慢了20%左右,特别是在《奇点灰烬》、《古墓丽影10》、《古墓丽影11》和《孤岛惊魂5》这几个游戏中更是大幅度落后。

在使用4000MHz双通道内存后,相比2133MHz双通道,还能额外增加8%的游戏性能。

这2年内存价格居高不下,很多同学在购机时往往选择单条8GB内存。如果想要发挥高端显卡的实力,双通道内存是基本要求,必要时可以选择高频内存条。

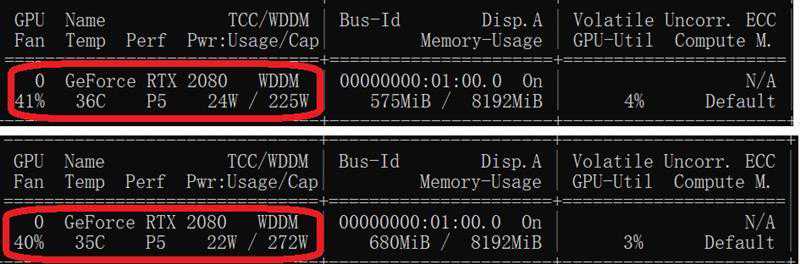

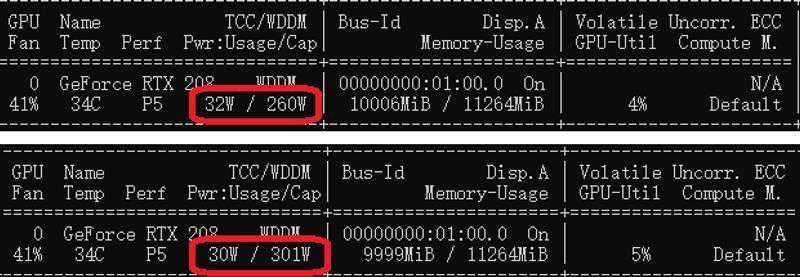

十四、超频测试:核心几无超频空间显存轻松15GHz

从帕斯卡开始,NVIDIA的技术就能在TDP允许的范围内最大限度提升核心频率,基础频率仅有1.5GHz的GTX1070实际游戏中运行频率经常能够超过2GHz。已经充分发挥了显卡的潜力,导致留给玩家的超频空间非常之小,一般也就能超过几十MHz而已了。

到了图灵时代,超频会不会有所好转呢?带着这个疑问,我们对2张图灵显卡的超频能力做了简要尝试。

首先是RTX2080,这张显卡默认TDP为225W,我们先将它拉到272W。

然后开始尝试提升核心频率,悲催的是,经过反复测试,在不加电压的情况下,最高只能将核心频率增加可怜的65MHz,再加一点点运行游戏时都会无响应。

不过好在美光显存超频能力不错,从14GHz拉到15GHz都能稳定运行,此时显卡的带宽达到了480GB/s,与GTX1080Ti持平。

超频之后3DMarkTimeSpy图形分数从默认的10838增加到了11632,增长了800分,提升幅度7.3%,核心频率最高能到2070MHz,大多数时候维持在2000MHz上下。

同样的事情也发生在RTX2080Ti身上,其默认TDP为260W,我们将它拉到301W。然后在调整核心频率的时候,也只能增加65MHz,显存频率则能从14GHz超至15GHz。

超频之后的RTX2080Ti3DMarkTimeSpy图形分数从默认的13661增加到了14763,增长了1100分,提升幅度8%。

十五、功耗温度测试:能耗比提升40%

1、功耗测试

公版RTX2080TDP达到了225W较GTX1080的180W增加了45W,而RTX2080Ti的TDP则为260W,比GTX1080Ti高出10瓦,让我看看他们世界的表现如何。

分别测试待机与Furmark烤机功耗,测试所用的电源为酷冷至尊MasterWattMaker1200W铂金电源。

图灵的功耗表现再一次给了我们惊喜,RTX2080烤机时整机功耗只有305W,仅仅比GTX1080高出了20W的功耗,却有着40%的性能提升。与GTX1080Ti相比,功耗低了35W,性能则强了15%。

同样的事情也发生在RTX2080Ti身上,其烤机功耗仅有330W。相比GTX1080Ti增加了768个流处理器,核心与显存频率都有所增加的情况下,功耗依然降低了10W,而性能则是强了40%以上。

对比AMD最强的VEGA64,RTX2080Ti在性能几乎翻倍的情况下,TDP只有对手的70%,能耗比差不多有3倍的差距。

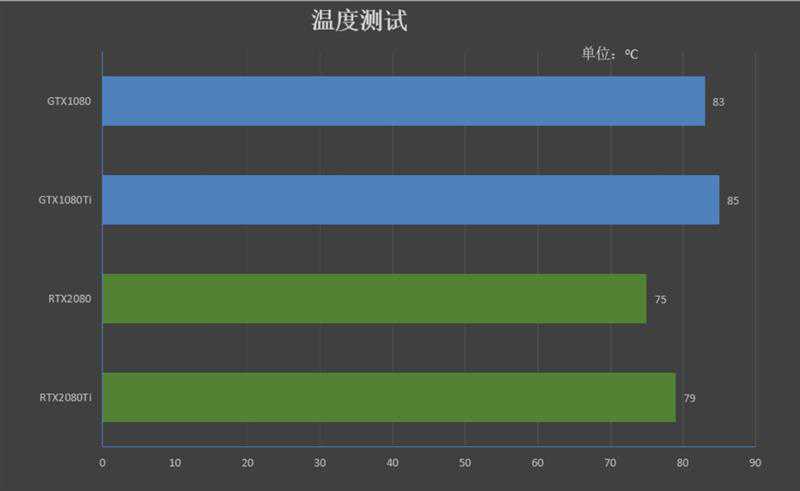

2、温度测试

由于参与对比评测的显卡都已在仓库存放许久,可能会出现硅脂干化等情况,因此不对这些显卡进行温度测试,我们在这里只测试2张图灵显卡的温度表现。测试时室温26度、测试软件为Furmark。

经过5分钟的Furmark烤机测试,RTX2080的温度稳定在75度。

同样是5分钟的Furmark烤机测试,RTX2080Ti的温度则稳定在79度。

图灵的公版显卡舍弃了原来的涡轮风扇改换成了现在的双风扇散热系统,温度也好看了很多。RTX2080烤机温度只有75度,比GTX1080低了8度,RTX2080Ti机温度为79度,比GTX1080Ti低了6度。

十六、DLSS测试:锯齿肉眼几乎不可见游戏性能毫无影响

3D游戏画面在运行时,物体边缘会产生“狗牙”(锯齿),分辨率越低,锯齿越严重,严重影响观感。由此产生了许许多多的抗锯齿技术,例如SSAA、SMAA、FXAA、TAA。以上这些技术要么需要对额外的像素进行渲染,要么需要对额外的帧进行渲染,无论怎样都需要消耗GPU资源,使游戏的帧率大大降低。有鉴于此,NVIDIA推出了DLSS(DeepLearningSuperSampling)深度学习超级采样抗锯齿技术。

不用于以往任何抗锯齿技术,DLSS使用图灵核心中的Tensor单元来进行运算,不需要消耗CUDA单元,因此不会对显卡的性能造成任何损失,不过却能得到等同于TAA(时间抗锯齿)的画质。

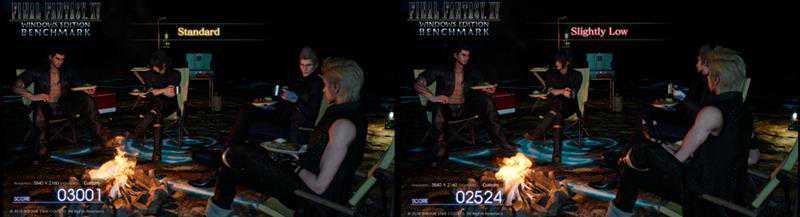

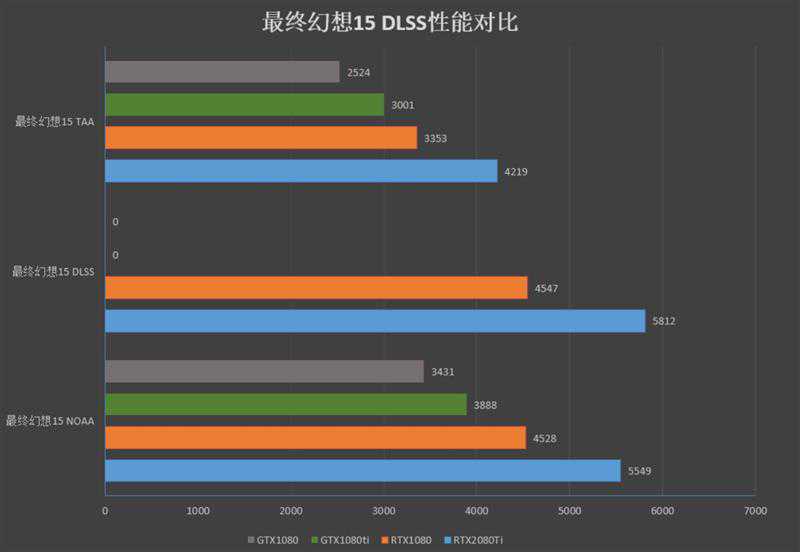

下面我们以最终幻想15BenchMark程序来体验DLSS的效果。

1、画质对比

这是未开启抗锯齿的画质,帧数很高,达到了59FPS。但是汽车边缘的锯齿感非常明显,要知道这可是4K分辨率,如果降低到1080P,锯齿现象会更加严重。

上图是开启了TAA抗锯齿的画面,汽车边缘的锯齿肉眼几乎不可见,但帧率也降低至43FPS。

这是开启了DLSS抗锯齿的画面,汽车的锯齿也基本上几乎看不到,但是帧率则维持在较高的57FPS,大大优于开启TAA时的表现。。

2、性能测试

GTX1080/1080Ti开启DLSS直接报错,只能运行于TAA模式。

左边是1080ti,开启TAA模式测得3001分;右边是GTX1080,TAA模式下的分数为2524分。

这是RTX2080的测试成绩,左边是开启了DLSS,分数为4547,右边则开启了TAA模式,分数3353。

这是RTX2080Ti的测试成绩,左边是开启了DLSS,分数为5812(很奇怪,超越了没开AA的分数,测试3次均是如此),右边则开启了TAA模式,分数4219。

测试成绩汇总如下:

在NOAA模式下,RTX2080Ti比GTX1080Ti强42%,RTX2080比GTX1080强了32%。开启TAA后,每张显卡都要损失25%左右的性能。但是2张图灵显卡在开启DLSS后,性能都没有下滑,RTX2080Ti性能甚至还有提升。

至于图灵DLSS与帕斯卡TAA性能对比,RTX2080Ti相比GTX1080Ti领先幅度增加到了93%,而RTX2080相比GTX1080领先幅度也提升到了80%。由此看来NVIDIA官方宣传的RTX2080DLSS性能相比GTX1080TAA提升一倍也有一定的依据。

十七、光线追踪测试:体验真实世界的光影效果

传统的光栅化渲染是将一个3D图形的几何信息转变为一个个栅格组成的2D图像的过程,可以理解为在这个3D图形的每个点都包含有颜色、深度以及纹理数据,经过一系列计算变换后,将其转换为2D图像的像素,进而呈现在显示设备上。

这一过程也就构成了我们爱游戏中所看到的各类阴影效果以及光线投射,在这过程中所有的光影效果都是提前设计好的,如果开发者设计时不那么严谨,就会在不应该有阴影的地方出现阴影。同时即便耗费巨大精力去提前设计好的所有阴影的可能情况,也只能做到无限接近于真实,况且这一点本身也很难做到。于是实时光线追踪(raytracing)便成为了玩家与游戏开发者最终极的选择与梦想。

传统的光线追踪技术是以光源为起点定义光线,进而追踪由此产生的光线与物体表面以及光线与光线之间交互关系的过程。但该技术目前实现起来非常困难,因为这一技术需要无限多的光线照射在物体表面,通过反射、折射、漫射等途径进入最终的“摄像机”成像。这一过程需要耗费大量的算力且会有大量光线损失。因此光线追踪技术自诞生之日起,就有人断言20年之内光线追踪不可能实现。

然而天才的NVIDIA工程师们解决了这个难题。提出了一种新的Raytracing理念,即是通过进入“摄像机”的光线,来回溯寻找光源。大部分从光源发出被折射或者漫反射不被玩家所看到的光线将不会被运算,这种思路将需要实时计算的光线数量降低了数十倍,使得实时光线追踪技术至少提前十年成为现实。

下面我们通过3DmarkRayTracingTechDemo来体验光线追踪的奇妙之处。

从上面2张图可以可以明显的看到小飞行器飞行时,在飞船上的倒影也是一直在变化方位。小飞机器自身也在发光,因此它的倒影的明暗度以及形状也是随时在发生着变化。

除此之外,大飞船本身也在缓慢滑行,周围的环形灯柱投射在飞船上的倒影也是无时无刻都在变化着。

RTX2080Ti集成了68个RTCores,每秒能处理100亿条光线,而GTX1080Ti只能靠CUDA来计算光线,每秒能处理11亿光线。下面我们通过星球大战DEMO来演示光线追踪的性能,这个DEMO可以为展现出一个犹如科幻电影般的光影世界。

这是GTX1080Ti的帧率,非常卡顿,仅有3.31FPS

由于星球大战DEMO锁定24FPS,RTX2080与RTX2080Ti都只能跑出24帧,即便如此,也达到了GTX1080Ti7倍以上的性能。

十八、总结:NVIDIA完成自我突破图灵彻底无敌

毫不夸张的说,图灵是NVIDIA是十年来最大的一次构架更新,其意义不亚于2006年发布的世界上第一块支持DirectX10的代号为G80的GeForce8800Ultra显卡。图灵的改进如此之多,我们此篇评测只是测试了其中一部分特性,之后还会有一篇补充评测。

图灵第一次将深度学习引入了游戏卡中,目前来说最主要的用途就是DLSS(深度学习超级采样抗锯齿),他能提供与TAA抗锯齿技术几乎相同的画质(未来会在画质上会超越TAA),但丝毫不会影响到游戏性能,在我们的测试中,RTX2080DLSS的性能领先GTX1080TAA达到了80%。

而RTX(实时光线追踪)是一项革命性的技术,NVIDIA花了整整10年时间来开发,才有现在的成果。过去所有的阴影技术无论看上去多么逼真,其实都是虚假的,实时光线追踪技术能构造出一个完全真实的光影世界。RTX2080Ti集成了68个RT核心,RTX-OPS性能十倍于GTX1080Ti,在星球大战DEMO测试中,后者仅能跑出3FPS的帧率,而RTX2080/2080Ti能轻松达到24FPS。

Turing还在每个流处理中增加了一个INT32整数单元,能将流处理器运算效能提升36%,因此在我们的测试中,2944个流处理器的RTX2080在游戏性能上比3584个流处理器的GTX1080Ti还要强了15%以上,而功耗更低。在能耗比这个指标上,图灵相比帕斯卡至少有30%的提升。

再来说说NVIDIA的老对手AMD。最近几年AMD的GPU研发几近停滞,相比NVIDIA一次又一次的彻底更新内核构架,AMD则是一个GCN构架从2011年一直用到现在(VEGA构架也是GCN之上做了一些修修补补)。目前VEGA与图灵的能耗比差距已经达到了3倍之多,这个差距之大,可能即将发布的7nm的VEGA游戏卡都难以弥补,然后明年又要面对NVIDIA7nm制程工艺的安培,结局不用想都很明了!

再说说图灵的售价,虽说他的性能完全对得起价格,但是售价一万元的游戏显卡已经远远超过的普通玩家的预算以及预期。如果AMD不能推出一款类似于图灵这样革命性的GPU构架,未来很长一段时间,独立显卡都将是NVIDIA一人的独角戏。

本文链接:https://nyjx.s9479.cn/402593432316.html